Die Taktiken, die Sekten verwenden, um Mitglieder zu rekrutieren und zu kontrollieren, wurden jahrzehntelang erforscht. Isolation von Außenperspektiven. Kontrolle darüber, welche Informationen jemanden erreichen. Emotionale Abhängigkeit schaffen. Kritisches Denken unterdrücken. Diese Techniken funktionieren, weil sie fundamentale Schwachstellen in der menschlichen Psychologie ausnutzen. Was Forscher jetzt erkennen, ist, dass Empfehlungsalgorithmen auf Social-Media-Plattformen verblüffend ähnliche Effekte produzieren können, selbst ohne menschliche Rekrutierer, die die Fäden ziehen. Die Erforschung der Psychologie der digitalen Radikalisierung offenbart eine unbequeme Wahrheit: dieselben Mechanismen, die Sekten effektiv machen, sind in das Design Ihres Social-Media-Feeds eingebaut.

Das bedeutet nicht, dass sich Silicon-Valley-Ingenieure hingesetzt und Sektenleitfäden studiert haben. Die Parallele entstand aus einem einfacheren Imperativ: Engagement maximieren. Aber die Engagement-Optimierung, unerbittlich durch maschinelles Lernen verfolgt, hat unabhängig zu Techniken konvergiert, die Psychologen längst als Werkzeuge der ungebührlichen Einflussnahme identifiziert haben. Die digitale Radikalisierung zu verstehen erfordert, diese Konvergenz zwischen antiken Manipulationstaktiken und modernem algorithmischem Design zu begreifen.

Das BITE-Modell trifft den Algorithmus

In den 1980er Jahren entwickelte der Sektenforscher Steven Hassan das BITE-Modell zur Beschreibung, wie destruktive Gruppen die Kontrolle über Mitglieder aufrechterhalten. BITE steht für Behavior (Verhalten), Information, Thought (Gedanken) und Emotional (Emotionale) Kontrolle[s]. Das Modell stützt sich auf Forschungen der Psychiater Robert Jay Lifton und Louis Jolyon West, die Gehirnwäschetechniken in totalitären Regimen untersuchten[s]. Jede Komponente zielt auf einen anderen Aspekt ab, wie Menschen die Realität verarbeiten und Entscheidungen treffen.

Empfehlungsalgorithmen berühren alle vier Komponenten. Sie formen Verhalten, indem sie bestimmen, welche Inhalte wann erscheinen, und schaffen Muster zwanghaften Überprüfens. Sie kontrollieren Informationen, indem sie filtern, was Nutzer erreicht und was unterdrückt wird. Sie beeinflussen Gedanken, indem sie bestimmte Weltanschauungen durch Wiederholung verstärken. Sie manipulieren Emotionen, indem sie Inhalte priorisieren, die starke Reaktionen auslösen. Die Plattformen haben diese Systeme nicht entworfen, um jemanden zu radikalisieren. Sie entwarfen sie, um Menschen beim Scrollen zu halten. Die Radikalisierung ist ein Nebeneffekt.

Informationskontrolle: Die Filterblase als Isolationskammer

Sekten beschränken den Zugang zu externen Informationen. Mitglieder werden davon abgehalten, kritisches Material zu lesen oder mit ehemaligen Mitgliedern zu sprechen[s]. Das Ziel ist sicherzustellen, dass die einzigen Informationen, die jemanden erreichen, die Weltanschauung der Gruppe verstärken.

Empfehlungsalgorithmen erreichen funktional etwas Ähnliches durch Personalisierung. Wenn YouTubes Algorithmus lernt, dass ein Nutzer auf bestimmte Inhalte reagiert, serviert er mehr vom gleichen. Forschung des Internet Policy Review fand, dass YouTube extreme und Randgruppeninhalte nach Nutzerinteraktionen mit rechtsextremen Materialien verstärkt[s]. Nutzer werden nicht in einem Raum eingesperrt und bekommen Propaganda gereicht. Sie bekommen einen Feed gereicht, der zunehmend einem solchen ähnelt.

Der Effekt verstärkt sich über die Zeit. Social-Media-Plattformen „drängen Nutzer in zunehmend enge ideologische Inhaltsbereiche in dem, was wir als Beweis einer milden ideologischen Echokammer bezeichnen könnten“, so Forschung von der New York University und Vanderbilt[s]. Die Verengung ist gradual genug, dass Nutzer oft nicht bemerken, wie es passiert.

Emotionale Manipulation: Die Dopaminfalle

Sekten verwenden Techniken namens „Love Bombing“ anfangs, dann Schuld, Angst und Scham zur Aufrechterhaltung der Kontrolle[s]. Die emotionale Achterbahn schafft Abhängigkeit und lässt Mitglieder das Verlassen fürchten.

Social-Media-Plattformen schaffen ihre eigene emotionale Abhängigkeit durch variable Belohnungspläne, denselben Mechanismus, der Spielautomaten süchtig macht. Nutzer werden „Opfer eines unerbittlichen Dopaminzyklus, der in einer Schleife des Verlangens entsteht, die durch endlose Social-Media-Feeds induziert wird, die nach Belohnungen in Form von Foto-Markierungen, Likes und Kommentaren suchen und diese erwarten“, so in Cureus veröffentlichte Forschung[s]. Die Unvorhersagbarkeit, wann der nächste Dopaminstoß kommt, hält Nutzer weit länger engagiert, als es jede konsistente Belohnung täte.

Algorithmen bringen bevorzugt Inhalte an die Oberfläche, die starke emotionale Reaktionen auslösen. „Algorithmen fördern normalerweise emotional provokatives oder kontroverses Material, indem sie sich auf Metriken wie Likes und Shares fokussieren und Feedback-Schleifen schaffen, die polarisierende Narrative verstärken“, bemerkt eine Analyse der Observer Research Foundation[s]. Angst und Empörung treiben mehr Engagement an als ruhige Analyse. Der Algorithmus lernt dies und optimiert entsprechend.

Die Geschwindigkeit der digitalen Radikalisierung

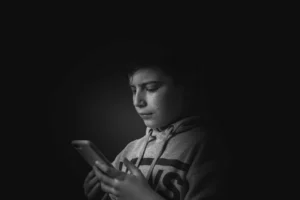

Traditionelle Sektenrekrutierung dauerte Monate oder Jahre. Ein Rekrutierer musste Vertrauen aufbauen, Ideen schrittweise einführen und das Ziel langsam von äußeren Einflüssen isolieren. Die digitale Radikalisierung operiert auf einer komprimierten Zeitachse.

„Ein Radikalisierungsprozess, der sich einst über Monate oder Jahre entfaltete, dauert jetzt typischerweise Tage oder sogar Stunden, größtenteils aufgrund der Verbreitung extremistischer Kurzvideo-Online-Propaganda“, berichtet das Soufan Center[s]. Derselbe Bericht bemerkt, dass Social-Media-Plattformen „gewalttätigen Extremisten ermöglichen, Jugendliche expeditiver als persönlich zu rekrutieren; Algorithmen leiten diese Jugendlichen zu emotional aufgeladenerem Inhalt“.

Diese Beschleunigung geschieht, weil Algorithmen Verhalten verarbeiten und Empfehlungen in Echtzeit anpassen können, viel schneller als jeder menschliche Rekrutierer reagieren könnte. Das System bemerkt, was Aufmerksamkeit hält, was geteilt wird, was eine Reaktion provoziert, und serviert sofort mehr davon.

Das Gegenargument: Den meisten Nutzern geht es gut

Kritiker der algorithmischen Radikalisierungstheorie verweisen auf Forschung, die zeigt, dass der Effekt begrenzt ist. Eine Studie von der New York University und Vanderbilt fand, dass nur 3% der Teilnehmer einen echten „Kaninchenbau“ der digitalen Radikalisierung erlebten, bei dem Empfehlungen zu progressiv extremerem Inhalt führten[s]. Die meisten Nutzer erhalten Empfehlungen, die ihre bestehenden Präferenzen widerspiegeln, anstatt sie zu Extremen zu drängen.

Forschung von der Nottingham Trent University schlussfolgert, dass „obwohl digitale Radikalisierung auftritt, mit und ohne Bezug auf Offline-Prozesse, die resultierende Bedrohung nicht übermäßig hoch ist“[s]. Die Mehrheit des extremistischen Inhaltskonsums scheint von Nutzern angetrieben zu werden, die aktiv danach suchen, anstatt von Algorithmen dorthin gedrängt zu werden.

Dieses Gegenargument verdient ernsthafte Betrachtung. Aber es verpasst einen wichtigen Punkt über die Größenordnung. Drei Prozent von YouTubes zwei Milliarden monatlichen Nutzern sind immer noch sechzig Millionen Menschen. Und die Forschung bemerkt spezifisch, dass die Einschätzung „sich nur auf die Gegenwart bezieht und unwahrscheinlich für die Zukunft gilt, angesichts des allgemeinen Wachstums und der Beschleunigung der Online-Aktivität unter terroristischen Akteuren“.

Was sich ändern sollte

Die Parallele zwischen digitaler Radikalisierung und Sektenrekrutierung bedeutet nicht, dass Plattformen absichtlich Extremisten schaffen. Es bedeutet, dass die reine Optimierung für Engagement, ohne Berücksichtigung psychologischer Schäden, Systeme produziert, die dieselben Schwachstellen ausnutzen, die Sektenführer schon immer ausgenutzt haben. Der Unterschied ist Größenordnung und Automatisierung.

Dieses Verständnis dieser Parallele weist auf Lösungen hin. Transparenz darüber, wie Algorithmen Inhalte auswählen, würde Forschern erlauben, schädliche Muster zu identifizieren, bevor sie Schaden anrichten. Systeme zu entwerfen, die für Nutzerwohl statt für reines Engagement optimieren, könnte die schädlichsten Verstärkungseffekte reduzieren. Medienkompetenz zu lehren, die algorithmische Bewusstheit einschließt, würde Nutzern helfen zu erkennen, wann ihre Informationsumgebung verengt wird.

Die Plattformen selbst haben begonnen, das Problem anzuerkennen. Issue Ones Council for Responsible Social Media hat Experten zu nationaler Sicherheit und Technologie versammelt, die schlussfolgereten, dass „Social-Media-Plattformen darauf ausgelegt sind, unsere Aufmerksamkeit zu maximieren, uns hineinzusaugen und süchtig zu halten“, indem sie „die Öffentlichkeit im Dunkeln darüber halten, wie Algorithmen bestimmte Inhalte hervorheben und Menschen tiefer und tiefer in Echokammern drängen“[s].

Die digitale Radikalisierung ist keine Verschwörung. Es ist eine emergente Eigenschaft von Systemen, die entworfen wurden, um Aufmerksamkeit um jeden Preis zu erfassen und zu halten. Die Tatsache, dass diese Systeme unabhängig Techniken entdeckt haben, die Sekten seit Jahrhunderten verwenden, sollte uns innehalten lassen. Es sollte uns auch Richtung geben: die psychologische Forschung zur Sektenwiederherstellung und -prävention kann Einsichten für die Gestaltung gesünderer digitaler Umgebungen bieten.

Das BITE-Modell der autoritären Kontrolle, entwickelt vom Sektenforscher Steven Hassan, bietet einen Rahmen zum Verständnis, wie Hochkontrollgruppen Einfluss auf Mitglieder durch Verhaltens-, Informations-, Gedanken- und Emotionsmanipulation aufrechterhalten[s]. Aufbauend auf Forschungen der Psychiater Robert Jay Lifton und Louis Jolyon West zu kommunistischen Gehirnwäschetechniken[s], identifiziert das Modell spezifische Mechanismen psychologischer Manipulation. Die Untersuchung der digitalen Radikalisierung durch diese Linse offenbart strukturelle Ähnlichkeiten zwischen Sektenrekrutierungsmustern und den Verhaltenseffekten von Empfehlungsalgorithmen, obwohl die Systeme durch völlig unterschiedliche Mechanismen operieren.

Die These hier ist nicht, dass Plattformingenieure Sektentechniken studierten und sie absichtlich implementierten. Vielmehr, dass die Optimierung für Engagement-Metriken unabhängig zu psychologischen Manipulationsstrategien konvergiert ist, die dieselben kognitiven Schwachstellen ausnutzen. Die digitale Radikalisierung zu verstehen erfordert, diese Konvergenz auf mechanistischer Ebene zu untersuchen.

Kartierung von BITE-Komponenten auf algorithmische Funktionen

Verhaltenskontrolle: Das BITE-Modell identifiziert Verhaltenskontrolle durch Regulation der physischen Realität, rigide Regeln und Belohnungs-/Bestrafungssysteme[s]. Empfehlungsalgorithmen erreichen Verhaltensregulation durch variable Ratenverstärkungspläne. In Cureus veröffentlichte Forschung dokumentiert, dass Nutzer in „einem unerbittlichen Dopaminzyklus gefangen werden, der in einer Verlangensschleife entsteht, die durch endlose Social-Media-Feeds induziert wird und Belohnungen sucht und erwartet“[s]. Die neurophysiologische Auswirkung umfasst veränderte Dopaminwege, „die Abhängigkeit analog zur Substanzsucht fördern“.

Informationskontrolle: Sekten beschränken den Zugang zu externen Informationen und ermutigen Mitglieder, Kritikern zu misstrauen[s]. Algorithmische Filterung schafft funktionale Informationsbeschränkung durch Personalisierung. Eine empirische Analyse im Internet Policy Review untersuchte Empfehlungssysteme auf YouTube, Reddit und Gab und fand, dass „YouTube extreme und Randgruppeninhalte verstärkt“ nach Interaktion mit rechtsextremen Materialien[s]. Der Effekt schafft das, was Forscher „algorithmische Radikalisierung nennen, die zeigt, wie Social-Media-Plattformen Nutzer in ideologische Kaninchenlöcher locken“[s].

Gedankenkontrolle: Sekten verlangen von Mitgliedern, Doktrin als Wahrheit zu verinnerlichen und Schwarz-Weiß-Denken anzunehmen[s]. Empfehlungsalgorithmen verlangen keinen Glauben, aber sie formen die Informationsumgebung in Weisen, die bestehende kognitive Verzerrungen verstärken. Forschung von NYU und Vanderbilt fand, dass „YouTubes Empfehlungsalgorithmus Nutzer effektiv in zunehmend enge ideologische Inhaltsbereiche drängt in dem, was wir als Beweis einer (sehr) milden ideologischen Echokammer bezeichnen könnten“[s].

Emotionskontrolle: Das BITE-Modell dokumentiert, wie Sekten Emotionen durch „Extreme emotionaler Höhen und Tiefen“ und „Phobien-Indoktrination“ manipulieren[s]. Algorithmen optimieren für emotionales Engagement, weil es Metriken antreibt. „Algorithmen fördern normalerweise emotional provokatives oder kontroverses Material, indem sie sich auf Metriken wie Likes und Shares fokussieren und Feedback-Schleifen schaffen, die polarisierende Narrative verstärken“[s].

Zeitliche Kompression in der digitalen Radikalisierung

Traditionelle Radikalisierung durch extremistische Gruppen folgt dem psychosozialen Modell der Rekrutierung und gewaltsamen Mobilisierung, das Phasen emotionaler Radikalisierung, doktrinärer Radikalisierung und gewaltsamer Enthemmung identifiziert[s]. Forschung zur 17-A-Zelle, die die Anschläge von Barcelona durchführte, fand, dass „einige Techniken denen ähneln, die von totalitären Sekten verwendet werden und darauf abzielen, die persönliche Identität des Ziels zu eliminieren, indem sie eine neue soziale Identität mit der extremistischen Gruppe verstärken“.

Digitale Umgebungen komprimieren diese Zeitachse dramatisch. Das Soufan Center berichtet, dass „ein Radikalisierungsprozess, der sich einst über Monate oder Jahre entfaltete, jetzt typischerweise Tage oder sogar Stunden dauert“[s]. Diese Beschleunigung tritt auf, weil Algorithmen Verhaltenssignale verarbeiten und Empfehlungen in Echtzeit anpassen. „Social-Media-Plattformen wie TikTok, X und Facebook ermöglichen es gewalttätigen Extremisten, Jugendliche expeditiver als persönlich zu rekrutieren; Algorithmen leiten diese Jugendlichen zu emotional aufgeladenem Inhalt“.

Methodische Einschränkungen und Gegenbeweis

Die Hypothese der algorithmischen Radikalisierung ist erheblichen empirischen Herausforderungen begegnet. Forschung, die tatsächliches Nutzerverhalten untersucht, anstatt algorithmische Ausgaben isoliert, findet begrenztere Effekte. Die Analyse von 527 YouTube-Nutzern mit echten Browserverläufen fand, dass obwohl der Algorithmus „Nutzer effektiv in zunehmend enge ideologische Bereiche drängt“, nur ein kleiner Anteil echte Kaninchenlöcher erlebt, die zu extremistischem Inhalt führen[s].

Forscher an der Nottingham Trent University, die quantitative Beweise zur Online-Radikalisierung in Terrorismuskontexten überprüften, schlussfolgereten, dass „obwohl Online-Radikalisierung auftritt, mit und ohne Bezug auf Offline-Prozesse, die resultierende Bedrohung nicht übermäßig hoch ist“[s]. Wichtig ist, dass sie bemerken, diese Einschätzung „bezieht sich nur auf die Gegenwart und wird wahrscheinlich nicht für die Zukunft gelten, angesichts des allgemeinen Wachstums und der Beschleunigung der Online-Aktivität unter terroristischen Akteuren“.

Die Unterscheidung zwischen nutzergetriebenem und algorithmusgetriebenem Inhaltskonsum ist methodisch kritisch. Viel extremistischer Inhaltskonsum kann Nachfrage anstatt Angebot widerspiegeln, wobei Nutzer aktiv Material suchen, das Algorithmen dann verstärken. Dies eliminiert nicht die Rolle der digitalen Radikalisierung, aber es kompliziert die kausale Attribution.

Politische Implikationen und Forschungsrichtungen

Expertenpanels, die von Issue Ones Council for Responsible Social Media versammelt wurden, haben das Kernproblem als Opazität identifiziert: „Social-Media-Plattformen sind darauf ausgelegt, unsere Aufmerksamkeit zu maximieren, uns hineinzusaugen und süchtig zu halten“, indem sie „die Öffentlichkeit im Dunkeln darüber halten, wie Algorithmen bestimmte Inhalte hervorheben“[s]. Diese Opazität verhindert unabhängige Verifikation der Radikalisierungseffekte und begrenzt die Fähigkeit, Interventionen zu entwerfen.

Die strukturelle Parallele zwischen digitaler Radikalisierung und Sektenmanipulation suggeriert, dass psychologische Forschung zu ungebührlichem Einfluss das Plattformdesign informieren kann. Das BITE-Modell wurde spezifisch entwickelt, um Individuen zu helfen zu erkennen, wann sie manipulativem Einfluss unterworfen sind[s]. Algorithmic-Literacy-Bildung könnte ähnliche Rahmen einbeziehen, um Nutzern zu helfen zu identifizieren, wann ihre Informationsumgebung künstlich verengt wird.

Die Konvergenz zwischen Engagement-Optimierung und psychologischer Manipulation ist keine Verschwörung, sondern eine emergente Eigenschaft von Systemen, die ohne angemessene Berücksichtigung kognitiver Schwachstellen entworfen wurden. Dieselbe psychologische Forschung, die Sektendynamiken beleuchtet, kann sich als wesentlich für die Gestaltung von Empfehlungssystemen erweisen, die informieren anstatt zu manipulieren.