Im Winter 1961 unterlief einem Meteorologen am Massachusetts Institute of Technology (MIT) ein Tippfehler, der die Wissenschaft für immer veränderte. Edward Lorenz führte eine Computersimulation von Wetterphänomenen durch, als er beschloss, eine Berechnung ab der Mitte erneut zu starten. Dazu gab er Zahlen aus einem früheren Ausdruck ein – statt 0,506127 tippte er jedoch 0,506.[s] Als er vom Kaffee zurückkehrte, hatte sich das simulierte Wetter in etwas völlig anderes verwandelt, die fehlenden 0,000127 hatten innerhalb weniger virtueller Monate ein völlig neues Klima erzeugt.

Dieser Zufall wurde zur Grundlage der Chaostheorie Mathematik: der Erforschung von Systemen, in denen winzige Unterschiede zu enormen Folgen führen. Lorenz formulierte es später mit einer berühmten Frage: „Kann der Flügelschlag eines Schmetterlings in Brasilien einen Tornado in Texas auslösen?“[s]

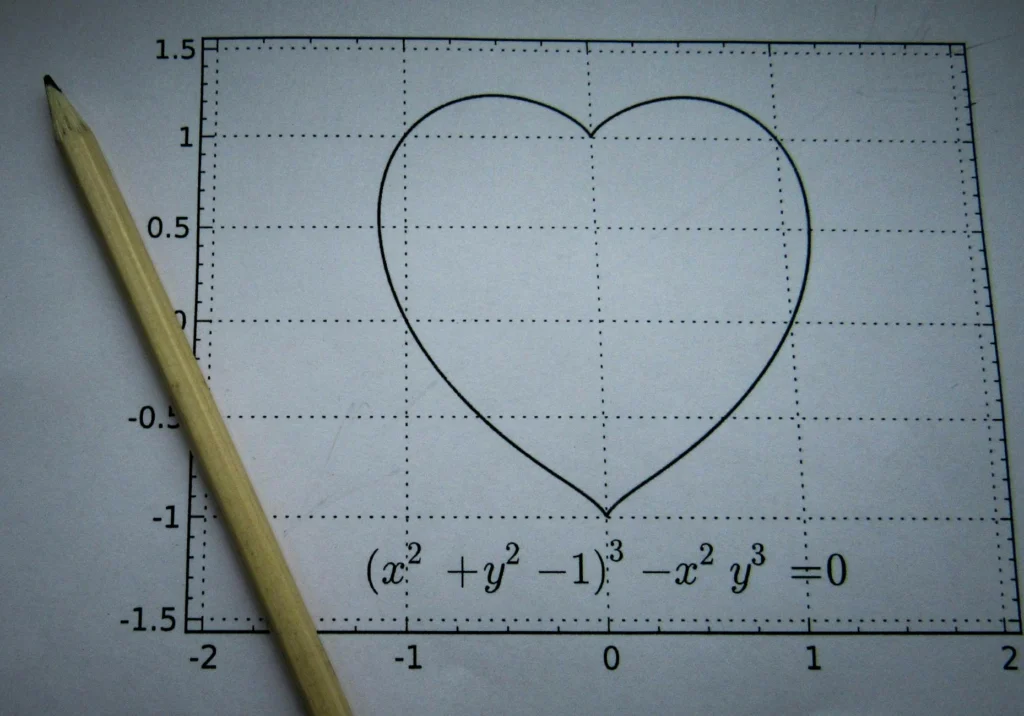

Ordnung im scheinbaren Chaos

Die zentrale Erkenntnis der Chaostheorie Mathematik ist kontraintuitiv. Chaotische Systeme sind nicht zufällig. Sie folgen deterministischen Regeln ohne jeglichen Zufall.[s] Dennoch sind sie über längere Zeiträume grundsätzlich unvorhersehbar. Lorenz fasste das Paradox zusammen: „Chaos: Wenn die Gegenwart die Zukunft bestimmt, aber die annähernde Gegenwart die Zukunft nicht annähernd bestimmt.“[s]

Betrachten wir ein Doppelpendel: zwei Arme, die durch Gelenke verbunden sind und frei schwingen. Es passiert nichts Zufälliges, jede Bewegung folgt exakt den Newtonschen Gesetzen. Doch wenn man zwei Doppelpendel aus Positionen startet, die sich nur um Haaresbreite unterscheiden, schwingen sie bald in völlig unterschiedlichen Mustern. Das System verstärkt mikroskopische Unterschiede, bis sie dominieren.

Die Grenzen der Vorhersagbarkeit

Diese Empfindlichkeit setzt der Prognosefähigkeit harte Grenzen. Wettervorhersagen, das Fachgebiet Lorenz’, sind nur etwa eine Woche zuverlässig.[s] Nicht weil es an Rechenleistung oder Daten mangelt, sondern weil die Messgenauigkeit begrenzt ist. Egal wie präzise die Instrumente sind, es bleibt immer eine Unsicherheit. In chaotischen Systemen wächst diese Unsicherheit exponentiell, bis sie die Vorhersage überlagert.

Verschiedene Systeme haben unterschiedliche „Vorhersagehorizonte“. Chaotische elektrische Schaltkreise werden innerhalb von etwa einer Millisekunde unvorhersehbar. Wettersysteme nach einigen Tagen. Das innere Sonnensystem bleibt für 4 bis 5 Millionen Jahre vorhersehbar.[s] Die zugrundeliegende Chaostheorie Mathematik gilt für all diese Systeme, nur der Zeitmaßstab unterscheidet sich.

Muster im Sturm

Trotz Unvorhersehbarkeit sind chaotische Systeme kein strukturloses Rauschen. Als Lorenz die Lösungen seiner Wettergleichungen in drei Dimensionen darstellte, zeichneten sie eine wunderschöne Form: zwei Lappen, die wie Schmetterlingsflügel verbunden waren – heute als Lorenz-Attraktor bekannt.[s] Das System wiederholte sich nie exakt, blieb aber auf dieses spezifische Muster beschränkt.

Diese „seltsamen Attraktoren“ offenbaren Ordnung unter dem Chaos. Die Bahn ist von Moment zu Moment unvorhersehbar, doch die Gesamtform bleibt stabil. Das Wetter lässt sich für den nächsten Monat nicht vorhersagen, aber wir wissen, dass die Erdtemperatur in diesem geologischen Zeitalter innerhalb bestimmter Grenzen bleiben wird. Die Chaostheorie Mathematik erklärt beides: warum wir die genaue Bahn nicht kennen können und warum wir die Möglichkeiten dennoch eingrenzen können.

Wo Chaos auftritt

Lorenz entdeckte das Chaos im Wetter, doch das Phänomen tritt überall auf. Ihr Herzschlag, Turbulenzen in Flüssigkeiten, Populationsdynamiken und Finanzmärkte zeigen alle chaotisches Verhalten.[s] In der Kardiologie nutzen Forscher die Chaostheorie Mathematik, um die Herzfrequenzvariabilität zu analysieren: Gesunde Herzen zeigen eine bestimmte Art chaotischer Schwankungen, während Herzen vor einem Versagen oft zu regelmäßig oder zu unregelmäßig werden.

Die Universalität reicht bis in die Mathematik selbst. 1975 entdeckte der Physiker Mitchell Feigenbaum, dass verschiedene chaotische Systeme mit derselben Rate ins Chaos übergehen, gesteuert von einer Konstanten: etwa 4,669.[s] Diese „Feigenbaum-Konstante“ tritt auf, ob man nun Populationswachstum, elektronische Schaltkreise oder tropfende Wasserhähne modelliert. Etwas Tiefgründiges in der Chaostheorie Mathematik verbindet alle chaotischen Systeme.

Ein ignorierter Vorläufer

Lorenz war nicht der Erste, der das Chaos erahnte. Bereits 1890 entdeckte der französische Mathematiker Henri Poincaré dasselbe Phänomen, als er das Dreikörperproblem untersuchte: die Vorhersage, wie drei Objekte unter dem Einfluss der Schwerkraft umeinander kreisen. Er fand heraus, dass die kleinste Abweichung in den Startpositionen zu völlig unterschiedlichen Ergebnissen führen konnte.[s] Poincaré vermutete sogar, dass der Effekt in der Meteorologie auftreten könnte.

Doch ohne Computer, die Millionen von Berechnungen durchführen konnten, blieb das Phänomen eine theoretische Kuriosität. Lorenz’ Computer machte das Chaos sichtbar. Sein Aufsatz von 1963 „Deterministic Nonperiodic Flow“ erhielt zunächst wenig Beachtung.[s] Erst in den 1970er-Jahren erkannte die Wissenschaftsgemeinde, was er entdeckt hatte.

Was das Chaos lehrt

Die Chaostheorie Mathematik besagt nicht, dass Vorhersagen unmöglich sind. Sie zeigt, dass einige Systeme grundsätzliche Grenzen der Vorhersagbarkeit haben. Zu verstehen, wo diese Grenzen liegen, ist an sich schon mächtig. Wir können keine spezifischen Aktienkurse Monate im Voraus vorhersagen, aber wir können erkennen, wenn Märkte in chaotische Phasen eintreten. Wir können das Wetter in drei Wochen nicht vorhersagen, aber wir können Klimatrends modellieren.

Der Schmetterlingseffekt wird oft missverstanden als die Idee, dass kleine Handlungen große Ergebnisse bewirken können. Die eigentliche Lehre ist bescheidener: In chaotischen Systemen lassen sich Ergebnisse nicht durch die Kontrolle von Eingaben steuern. Derselbe Flügelschlag könnte einen Tornado verhindern, einen Tornado auslösen oder gar nichts bewirken. Chaos bedeutet, zu akzeptieren, dass Determinismus und Vorhersagbarkeit nicht dasselbe sind.

Im Januar 1961 gab Edward Lorenz Zwischenwerte aus einer früheren Wettersimulation erneut ein und kürzte 0,506127 auf 0,506 ab, um Zeit zu sparen. Die resultierende Bahn wich innerhalb weniger simulierter Monate vollständig von der ursprünglichen ab.[s] Dieser Rundungsfehler in der dritten Dezimalstelle enthüllte eine Eigenschaft, die zum zentralen Konzept der Chaostheorie Mathematik werden sollte: die sensitive Abhängigkeit von den Anfangsbedingungen, heute formalisiert durch Ljapunow-Exponenten und Kriterien der topologischen Mischung.

Formale Definition von Chaos

Die Chaostheorie Mathematik definiert ein dynamisches System als chaotisch, wenn es drei Bedingungen erfüllt: Sensitivität gegenüber Anfangsbedingungen, topologische Transitivität und dichte periodische Orbits.[s] Sensitivität bedeutet, dass beliebig nahe Anfangszustände sich im Laufe der Zeit auseinanderentwickeln. Topologische Transitivität bedeutet, dass sich das System so entwickelt, dass jede offene Menge schließlich mit jeder anderen offenen Menge im Phasenraum überlappt. Dichte periodische Orbits bedeuten, dass jeder Punkt im Phasenraum beliebig nahe von periodischen Bahnen erreicht wird.

Für stetige Abbildungen auf metrischen Räumen implizieren die letzten beiden Bedingungen die erste.[s] Das praktische Kennzeichen von Chaos ist der positive maximale Ljapunow-Exponent, der die exponentielle Rate quantifiziert, mit der sich benachbarte Bahnen auseinanderentwickeln. Diese fundamentale Eigenschaft der Chaostheorie Mathematik ist entscheidend für das Verständnis dynamischer Systeme.

Ljapunow-Exponenten

Der Ljapunow-Exponent λ misst, wie schnell sich eine infinitesimale Trennung δZ₀ zwischen zwei Bahnen über die Zeit t entwickelt: |δZ(t)| ≈ e^(λt)|δZ₀|.[s] Das Vorzeichen bestimmt das Systemverhalten: λ < 0 deutet auf Anziehung zu stabilen Fixpunkten oder periodischen Orbits hin; λ = 0 zeigt neutrale Stabilität an; λ > 0 weist auf Chaos hin, bei dem sich benachbarte Bahnen exponentiell auseinanderentwickeln.[s]

Für diskrete Abbildungen x_{n+1} = f(x_n) reduziert sich der Ljapunow-Exponent auf einen Zeitmittelwert von log|df/dx| entlang der Bahn. Dies ermöglicht die numerische Berechnung durch Iteration und ist zentral für die Chaostheorie Mathematik.

Das Lorenz-System

Lorenz modellierte atmosphärische Konvektion mit drei gekoppelten gewöhnlichen Differentialgleichungen: dx/dt = σ(y − x), dy/dt = ρx − y − xz, dz/dt = xy − βz, wobei σ das Verhältnis von Viskosität zu Wärmeleitfähigkeit, ρ den Temperaturgradienten und β das Seitenverhältnis der Konvektionszellen darstellt.[s]

Für Standardparameter (σ = 10, ρ = 28, β = 8/3) konvergieren die Lösungen zum Lorenz-Attraktor: einem seltsamen Attraktor mit einer fraktalen Dimension von etwa 2,06. Die Hausdorff-Dimension des Attraktors übersteigt seine topologische Dimension, eine definierende Eigenschaft von Fraktalen. Die Bahnen wiederholen sich nie, bleiben aber innerhalb der zweilappigen Struktur des Attraktors begrenzt.

Periodenverdopplung und die Feigenbaum-Konstante

Viele Systeme nähern sich dem Chaos durch Periodenverdopplungs-Bifurkationen. Mit zunehmendem Kontrollparameter wird ein stabiler Fixpunkt zu einem 2-Zyklus, dann zu einem 4-Zyklus, 8-Zyklus und so weiter, bis Chaos entsteht. Mitchell Feigenbaum entdeckte 1975, dass das Verhältnis aufeinanderfolgender Bifurkationsintervalle gegen eine universelle Konstante δ ≈ 4,66920160910299 konvergiert.[s]

Diese Universalität gilt für alle eindimensionalen Abbildungen mit einem einzigen quadratischen Maximum: die logistische Abbildung x_{n+1} = rx_n(1 − x_n), Sinus-Abbildungen und verwandte Systeme verzweigen sich alle mit derselben Rate. Die Feigenbaum-Konstante wurde experimentell in Flüssigkeitskonvektion, elektronischen Schaltkreisen und chemischen Reaktionen bestätigt und zeigt, dass die Chaostheorie Mathematik reale physikalische Phänomene erfasst.

Poincarés Vorläufer

Henri Poincaré stieß 1890 auf die sensitive Abhängigkeit, als er seine preisgekrönte Abhandlung über das Dreikörperproblem korrigierte. Er entdeckte, dass infinitesimale Variationen in den Anfangsbedingungen für drei sich gegenseitig anziehende Körper zu fundamental unterschiedlichen Langzeitbahnen führen konnten.[s] Poincaré erkannte, dass dies Grenzen für die Vorhersagbarkeit himmlischer Bewegungen implizierte, und spekulierte, dass das Phänomen auch in der Meteorologie auftreten könnte.

Ohne rechnerische Werkzeuge konnte Poincaré die vollen Implikationen nicht visualisieren. Lorenz’ Aufsatz von 1963 „Deterministic Nonperiodic Flow“ lieferte die erste numerische Demonstration, dass begrenzte, deterministische Systeme aperiodisches Verhalten zeigen können, das von Zufälligkeit nicht zu unterscheiden ist.[s]

Ljapunow-Zeit und Vorhersagehorizonte

Die Ljapunow-Zeit τ = 1/λ charakterisiert, wie lange Vorhersagen sinnvoll bleiben. Nach etwa 2-3 Ljapunow-Zeiten wächst der Vorhersagefehler auf die Skala der natürlichen Variabilität an und macht die Prognose bedeutungslos. Charakteristische Ljapunow-Zeiten variieren dramatisch: etwa 1 Millisekunde für chaotische Schaltkreise, Tage für das Wetter und 4-5 Millionen Jahre für das innere Sonnensystem.[s]

Die Chaostheorie Mathematik quantifiziert somit die Grenzen der Vorhersagbarkeit für jedes System. Diese Grenzen sind den Dynamiken inhärent und keine Artefakte von Messung oder Berechnung. Eine Verbesserung der Genauigkeit verzögert den Vorhersagehorizont, kann ihn aber nicht beseitigen.

Anwendungen jenseits der Meteorologie

Chaotische Dynamiken treten in vielfältigen Systemen auf: turbulente Strömungen, Herzrhythmusstörungen, Populationsökologie, neuronale Aktivität und Finanzmärkte.[s] In der Kardiologie korreliert eine verringerte Herzfrequenzvariabilität mit erhöhter Mortalität nach einem Myokardinfarkt; gesunde kardiale Dynamiken zeigen eine fraktale Struktur, die durch detrendierte Fluktuationsanalyse und approximative Entropie quantifizierbar ist.

Die Chaostheorie Mathematik bietet den Rahmen, um deterministisches Chaos von stochastischem Rauschen zu unterscheiden, fraktale Dimensionen zu schätzen und Regimewechsel zu identifizieren. Seltsame Attraktoren, die aus Zeitreihen rekonstruiert werden, können zugrundeliegende niedrigdimensionale Dynamiken in scheinbar komplexen Systemen aufdecken.