Opinion.

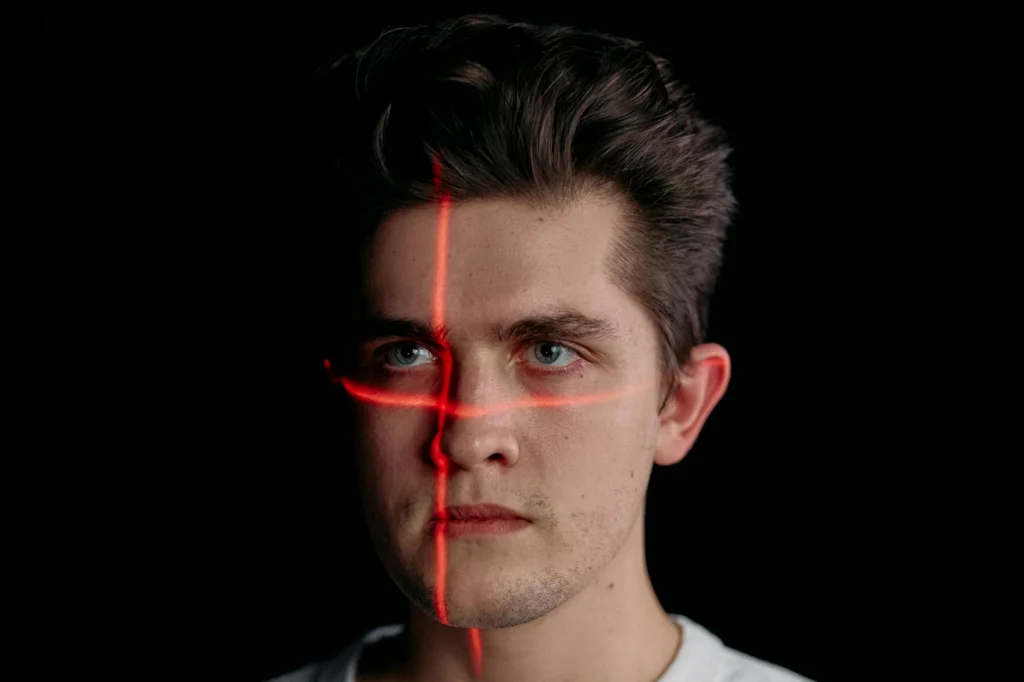

Les outils de détection IA sont désormais intégrés dans les universités, les rédactions de presse et les processus de recrutement à travers le monde. GPTZero, ZeroGPT, Originality.ai et leurs concurrents promettent de distinguer l’écriture humaine de la production automatisée avec une précision scientifique. Ils ne le peuvent pas. Ce qu’ils détectent réellement est un type spécifique de régularité statistique qui corrèle davantage avec une prose claire et structurée qu’avec l’intelligence artificielle. Le résultat est un système qui punit la bonne écriture et signale de manière disproportionnée les locuteurs non natifs de l’anglais, tout en n’offrant aucune méthodologie évaluée par des pairs et aucun bilan honnête de son taux d’erreur.

L’affirmation centrale de ces outils repose sur deux métriques : la perplexité et la variabilité (burstinessEn analyse de texte, la variation de prévisibilité au fil d'un document. L'écriture humaine alterne passages surprenants et attendus (forte burstiness) ; le texte généré par IA tend à être uniformément prévisible du début à la fin (faible burstiness).). La perplexité mesure à quel point un texte est prévisible pour un modèle de langageSystème d'apprentissage entraîné sur de vastes quantités de texte qui prédite et génère le langage humain. Ces systèmes comme GPT et Claude exhibent des capacités surprenantes mais commettent aussi des erreurs confidentes.. Une faible perplexité signifie que le modèle trouve le texte peu surprenant ; une perplexité élevée signifie que le texte contient des choix lexicaux inattendus. La variabilité mesure les fluctuations de cette prévisibilité dans un document : des mots et phrases surprenants répartis dans le texte indiquent une variabilité élevée. La théorie est que l’IA génère un texte avec une perplexité et une variabilité uniformément basses (une prose fluide et prévisible), tandis que l’écriture humaine est plus désordonnée, plus variée, plus surprenante.

Cela semble raisonnable jusqu’à ce qu’on considère ce que cela mesure réellement. Un texte à faible perplexité n’est pas nécessairement généré par une machine. C’est un texte qui utilise un vocabulaire courant, une grammaire conventionnelle et des structures de phrases directes. En pratique, c’est une prose bien organisée et clairement rédigée. Un article académique avec un argument logique et un langage précis sera classé comme plus « semblable à l’IA » qu’un message de forum décousu truffé de fautes de frappe et de fragments de phrases. Le détecteur n’identifie pas une machine. Il identifie un schéma que les humains ont inventé bien avant que l’IA n’existe.

Le biais contre les locuteurs non natifs de l’anglais

En 2023, des chercheurs de l’université Stanford ont publié une étude dans la revue Patterns qui aurait dû clore le débat sur les outils de détection IA en milieu éducatif. Weixin Liang et ses collègues ont testé sept détecteurs GPT populaires sur des essais rédigés par des locuteurs natifs et non natifs de l’anglais. Les détecteurs ont correctement identifié les essais des locuteurs natifs comme écrits par des humains dans presque tous les cas. Mais ils ont classé plus de 61 % des essais du TOEFL, rédigés par de véritables étudiants non anglophones, comme générés par l’IA. La quasi-totalité des 91 essais du TOEFL (97 %) ont été signalés par au moins un détecteur. Dix-huit essais ont été unanimement identifiés comme générés par l’IA par les sept outils.

Le mécanisme est simple. Les rédacteurs non natifs de l’anglais tendent à utiliser un vocabulaire plus simple, des phrases plus courtes et des structures grammaticales plus conventionnelles. Ils évitent les expressions idiomatiques et l’enchâssement de propositions complexes, car ce sont les caractéristiques les plus difficiles d’une langue à acquérir. Cela produit exactement le type de texte à faible perplexité et faible variabilité que les détecteurs interprètent comme une production automatisée. Le détecteur ne sait pas et ne se soucie pas qu’un être humain se soit assis à un bureau et ait choisi ces mots avec soin dans une langue seconde. Il voit une régularité statistique et l’appelle artificielle.

Ce n’est pas un problème mineur de calibration. Dans les universités qui utilisent des outils de détection IA pour filtrer les travaux étudiants, un locuteur non natif de l’anglais qui rédige soigneusement et correctement dans sa langue seconde a statistiquement plus de chances d’être accusé de triche qu’un locuteur natif soumettant un travail bâclé et non révisé. L’outil ne détecte pas la malhonnêteté. Il détecte l’empreinte linguistique de quelqu’un qui a appris l’anglais dans les manuels plutôt que dès la naissance.

La Constitution américaine est apparemment générée par l’IA

ZeroGPT, l’un des outils gratuits de détection les plus utilisés, a classé 92 % de la Constitution des États-Unis comme générée par l’IA. La Bible a déclenché des résultats similaires. Des résumés juridiques des années 1990, des décennies avant l’existence des grands modèles de langage, ont été classés comme probablement écrits par une machine. Ce ne sont pas des cas limites ni des entrées adverses conçues pour casser le système. Ce sont des textes simples, rédigés en anglais formel, avec le type de clarté structurelle que les détecteurs interprètent comme non humain.

Cela devrait être disqualifiant. Un outil qui ne peut pas distinguer entre le document fondateur d’une démocratie et une production de ChatGPT ne détecte pas l’IA. Il détecte la formalité. Il détecte la cohérence. Il détecte un artefact de compression de sa propre méthodologie, pas une propriété de l’origine du texte.

Pas de méthodologie évaluée par des pairs, pas de taux d’erreur divulgués

Les entreprises derrière les outils de détection IA publient des chiffres de précision qui impressionnent dans les supports marketing : 99 % de précision, 98 % d’exactitude. Ces chiffres proviennent de tests internes, réalisés sur des jeux de données que les entreprises sélectionnent et contrôlent. Les évaluations indépendantes racontent une autre histoire. Le propre classificateur d’OpenAI, de l’aveu de l’entreprise, n’identifiait correctement que 26 % des textes générés par l’IA tout en signalant incorrectement 9 % des textes humains comme écrits par une machine. Les autres détecteurs n’ont pas fait mieux lors de tests indépendants, avec des taux de faux positifsLa proportion de cas négatifs qu'un classifieur étiquette incorrectement comme positifs. Un taux élevé indique que le modèle sur-signale des éléments non pertinents. variant considérablement selon le genre textuel et le style d’écriture.

Aucun outil majeur de détection IA n’a soumis sa méthodologie centrale à un examen indépendant par les pairs. Les modèles propriétaires sont des boîtes noires. Les utilisateurs ne peuvent pas inspecter la frontière de décision, ne peuvent pas comprendre pourquoi un texte spécifique a été signalé, et ne peuvent pas contester un résultat de manière significative. Quand une université utilise ces outils pour juger des cas d’intégrité académique, elle externalise un jugement lourd de conséquences vers un produit commercial dont la logique interne est secrète et dont le taux d’erreur est, au mieux, mal caractérisé.

Comparez cela à d’autres outils médico-légaux utilisés pour des décisions à enjeux élevés. L’analyse ADN dispose de taux d’erreur publiés, de protocoles standardisés et de décennies de validation par les pairs. Même l’analyse des empreintes digitales, malgré ses limitations connues, fonctionne sous des normes publiées. Les outils de détection IA demandent à être traités avec la même autorité épistémique tout en ne fournissant aucune des mêmes garanties de responsabilité.

Blanchir le biais en un chiffre objectif

Le problème le plus profond des outils de détection IA n’est pas qu’ils sont inexacts, bien qu’ils le soient. C’est qu’ils convertissent un jugement subjectif et culturellement chargé (« cette écriture semble trop soignée pour être humaine ») en un score numérique qui paraît objectif. Un professeur qui refuserait de noter la dissertation d’un étudiant parce qu’elle « sonne trop polie » ferait face à des objections raisonnables. Mais un professeur qui pointe un score de probabilité IA de 94 % de GPTZero peut présenter le même ressenti comme une analyse fondée sur les données.

C’est du blanchiment de biais. L’outil hérite de chaque hypothèse intégrée dans ses données d’entraînement et son seuil de détection, puis présente le résultat comme une mesure neutre. Les hypothèses incluent : que l’écriture humaine est intrinsèquement désordonnée, que la prévisibilité signale l’artificialité, que la sophistication linguistique dans une langue seconde est suspecte. Aucune de ces hypothèses n’est explicitement formulée. Aucune n’est défendable. Mais elles sont encodées dans le modèle et livrées à l’utilisateur sous forme de pourcentage.

Le schéma est familier. Les algorithmes de notation de crédit qui pénalisent les codes postaux comme substitut de la race. Les outils de recrutement qui dégradent les CV portant des noms associés à certaines ethnicités. Les modèles de prédiction de récidiveLa tendance des criminels condamnés à récidiver et à retourner au comportement criminel après leur libération de prison. qui signalent les indicateurs de pauvreté comme facteurs de risque. Dans chaque cas, le mécanisme est le même : un système qui transforme le biais structurel en un chiffre, puis se cache derrière l’objectivité apparente de ce chiffre.

L’aboutissement logique : écrire plus mal pour prouver qu’on est humain

Si les outils de détection IA deviennent la norme d’évaluation de l’écriture, la structure d’incitation s’inverse. Les étudiants apprennent à écrire moins clairement, à utiliser plus de familiarités, à introduire des imperfections délibérées, et à éviter le type d’argumentation structurée qui déclenche un signalement. Les professionnels apprennent à rendre leur prose plus rugueuse. Les locuteurs non natifs apprennent que leur maîtrise soignée et durement acquise de l’anglais constitue en elle-même une preuve contre eux.

L’aboutissement logique de ce système est absurde et mérite d’être formulé clairement : plus vous écrivez mal, plus vous êtes humain. La clarté devient suspecte. La cohérence devient preuve de fraude. Le plus grand compliment qu’un outil de détection peut faire à votre écriture est de vous accuser de ne pas l’avoir écrite.

Ce n’est pas hypothétique. Des étudiants ont déjà été accusés d’utilisation de l’IA pour avoir soumis des travaux bien rédigés. Des universitaires ont vu leurs articles signalés. Le Center for Democracy and Technology a publié un rapport en 2023 documentant les effets disproportionnés sur les apprenants d’anglais, avertissant que ces outils risquent de créer un système à deux vitesses où la maîtrise linguistique devient un handicap.

L’argument le plus fort et pourquoi il échoue

L’argument le plus solide en faveur de ces produits de détection est que quelque chose vaut mieux que rien. Les universités font face à un vrai problème : les étudiants peuvent désormais générer des dissertations acceptables en quelques touches, et la détection traditionnelle du plagiat (qui compare à une base de textes existants) ne peut pas détecter une production IA originale. Les institutions ont besoin d’un mécanisme pour maintenir l’intégrité académique, et des détecteurs imparfaits, selon l’argument, fournissent au moins un point de départ pour une enquête.

Cet argument échoue pour une raison précise. Un outil avec un taux de faux positifs de 10 à 20 %, déployé à grande échelle sur des milliers d’étudiants, ne fournit pas un point de départ pour une enquête. Il fournit un point de départ pour une accusation. En pratique, le score devient le verdict. Les étudiants signalés par ces outils portent le fardeau de prouver qu’ils ont écrit leur propre travail, une inversion de la présomption d’innocence qui serait inacceptable dans tout autre contexte. Et les étudiants les plus susceptibles d’être signalés sont ceux dont les schémas d’écriture, que ce soit en raison de leur parcours linguistique ou de leur discipline stylistique, ressemblent au profil statistique que l’outil associe aux machines.

L’approche supérieure est aussi la plus difficile : concevoir des évaluations que l’IA ne peut pas facilement reproduire (rédaction en classe, soutenance orale, documentation du processus), investir dans une pédagogie qui fait de l’assistance IA un outil plutôt qu’un raccourci, et accepter que le paysage de l’écriture a changé d’une manière qu’un produit commercial de détection ne peut pas défaire.

Ce que les outils de détection IA sont réellement

Les outils de détection IA sont des produits de confiance. Ils vendent de la certitude à des institutions anxieuses face à une technologie qu’elles ne comprennent pas pleinement. Le score de probabilité de 94 % n’est pas une mesure de la réalité. C’est une mesure de l’état interne du modèle, reflétant les propriétés statistiques d’un texte par rapport à une distribution d’entraînement qui confond clarté et artificialité.

Les outils ne savent pas qui a écrit un texte. Ils ne peuvent pas le savoir. Ils ne peuvent que rapporter à quel point un modèle de langage serait surpris par les choix lexicaux du texte. Et la surprise, en fin de compte, corrèle faiblement avec la paternité d’un texte. Un humain qui écrit clairement ne surprend pas plus le modèle qu’une machine. Une machine à qui l’on demande d’écrire de façon erratique ne le surprend pas moins qu’un humain.

Tant que ces outils ne se soumettront pas à une validation indépendante, ne publieront pas des taux d’erreur honnêtes ventilés par groupe démographique, et ne démontreront pas que leur méthodologie peut survivre à l’examen par les pairs, ils ne devraient être utilisés dans aucune décision affectant le parcours académique, la carrière ou la réputation d’une personne. L’état actuel de la détection IA n’est pas un problème technologique en attente d’un meilleur algorithme. C’est un échec épistémologique : la croyance qu’un substitut statistique du style d’écriture peut remplacer la connaissance de la paternité d’un texte. Il ne le peut pas.