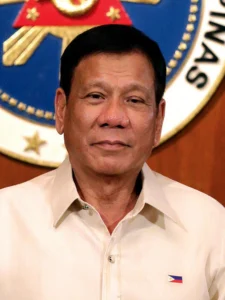

Angela Lipps, une grand-mère de 50 ans originaire du Tennessee, n’avait jamais mis les pieds dans le Dakota du Nord. Elle n’avait même jamais pris l’avion avant son extradition. En juillet 2025, elle a été arrêtée dans le Tennessee sur la base d’un mandat délivré à Fargo, à plus de 1 600 kilomètres de chez elle, pour des accusations de fraude bancaire dans un État où elle affirme n’être jamais allée[s].

Lipps a passé plus de cinq mois en détention, d’abord dans le Tennessee avant son extradition, puis dans le Dakota du Nord. Ses avocats ont déclaré que ses relevés bancaires prouvaient sa présence dans le Tennessee au moment des fraudes présumées, et que les policiers n’avaient pas vérifié si elle s’était rendue dans le Dakota du Nord. L’affaire a débuté avec une piste fournie par Clearview AI, une startup de reconnaissance faciale disposant de milliards de photos collectées en ligne, et ses avocats ont décrit cette détention comme ce qu’ils considèrent être le plus long cas de détention abusive liée à l’IA dans l’histoire des États-Unis[s][s].

Lipps fait partie d’au moins 14 Américains ayant été arrêtés à tort après que la police a cru aveuglément aux résultats erronés d’un système de reconnaissance faciale[s]. Le schéma est toujours le même : un algorithme génère une piste, les policiers sautent les vérifications de base, et une personne peut perdre des mois, voire des années de sa vie. Cette technologie crée ce qu’on pourrait appeler un « jumeau numérique », un profil statistique qui suit les suspects jusque dans les tribunaux et les audiences de libération conditionnelle, remplaçant souvent l’enquête réelle que le due process exige.

Les algorithmes de police prédictive remplacent l’enquête

La promesse des algorithmes de police prédictive était l’efficacité : des ordinateurs analysant d’immenses ensembles de données pour repérer des schémas que les humains ne verraient pas. La réalité s’est révélée bien plus proche d’une accusation automatisée. Partout aux États-Unis, les services de police ont adopté des outils de fusion de données pilotés par l’IA pour compiler et analyser les informations policières et de surveillance, tandis que des systèmes algorithmiques influencent également les décisions judiciaires en matière de caution, de condamnation et de libération conditionnelle[s][s].

Le Brennan Center for Justice a documenté comment les plateformes modernes de fusion de données diffèrent fondamentalement des bases de données policières traditionnelles. Alors que les anciens systèmes fournissaient des informations que les policiers pouvaient évaluer, les outils d’IA actuels « génèrent automatiquement des conclusions pour la police, sans contexte ni explication »[s]. Des plateformes comme Cognyte NEXYTE, C3.ai, Peregrine ou Flock Safety Nova peuvent agréger des dossiers d’arrestation, des lecteurs de plaques d’immatriculation, des données issues des réseaux sociaux, des détections de coups de feu et de la reconnaissance faciale pour créer des profils unifiés. Les cas d’arrestations abusives montrent que les policiers peuvent considérer les résultats algorithmiques comme des motifs probables plutôt que comme des pistes nécessitant une vérification.

Cela représente un changement fondamental dans la manière dont la culpabilité est établie. La police traditionnelle exigeait des agents qu’ils élaborent une théorie, recueillent des preuves et établissent des motifs probables par une enquête. Les algorithmes de police prédictive inversent ce processus : le système génère une conclusion, et l’enquête, si elle a lieu, travaille à rebours pour la justifier.

Les biais intégrés à la machine

Les problèmes posés par ces systèmes vont bien au-delà des raccourcis procéduraux. Les données alimentant les algorithmes de police prédictive reflètent des décennies de pratiques policières discriminatoires. Une enquête de ProPublica en 2016 a révélé que COMPAS, un outil d’évaluation des risques largement utilisé, signalait à tort les accusés noirs comme futurs criminels à un taux près de deux fois supérieur à celui des accusés blancs[s].

La Harvard Human Rights Journal, dans une analyse primée en 2025, a expliqué pourquoi ce biais est structurel plutôt qu’accidentel. Les instruments actuariels d’évaluation des risques « sont doublement racialisés : d’abord, ils incluent des facteurs fondés sur les normes de la blanchité, et ensuite, ils utilisent des facteurs de risque hautement racialisés comme les antécédents judiciaires »[s]. Lorsque des communautés ont été surpoliciées pendant des générations, leurs casiers judiciaires reflètent ce surpoliciage, et non des taux de criminalité plus élevés. Les algorithmes entraînés sur ces données apprennent à cibler ces mêmes communautés comme présentant un risque élevé, créant ainsi une boucle de rétroaction qui aggrave les inégalités.

La reconnaissance faciale aggrave ces disparités. L’étude Gender Shades de 2018, devenue une référence, a montré que les systèmes commerciaux affichaient des taux d’erreur de seulement 0,8 % pour les hommes à la peau claire, mais de 34,7 % pour les femmes à la peau plus foncée, soit un écart de 1 à 40[s]. Sans surprise, la majorité des arrestations abusives connues liées à la reconnaissance faciale concernent des personnes noires[s]. La technologie traite les minorités comme des objets dans une matrice de probabilités, effaçant leurs circonstances individuelles au profit de généralisations statistiques.

Le due process à l’ère des algorithmes

Les implications constitutionnelles sont graves. Les systèmes juridiques fondés sur le due process exigent des décisions qui puissent être « expliquées, contestées et justifiées », comme l’a écrit la juriste Tuğba Tosun Çobanoğlu dans JURIST. Pourtant, de nombreux systèmes prédictifs « fonctionnent comme des boîtes noires propriétaires, ce qui signifie que même les juges et les accusés peuvent ne pas comprendre pleinement comment un score de risque particulier a été produit. Lorsque la liberté est en jeu, une telle opacité devient profondément problématique »[s].

La Law Society of England and Wales a mené un examen approfondi des systèmes algorithmiques dans la justice pénale et a constaté « des défis importants en matière de biais, de discrimination, d’opacité et de respect du due process »[s]. Il ne s’agit pas de cas marginaux ou d’erreurs de mise en œuvre. Ce sont des caractéristiques de systèmes conçus pour générer des conclusions sans le travail fastidieux et chronophage d’une véritable enquête.

Le résultat est que « l’accusé individuel devient moins une personne devant la loi qu’un point de données au sein d’un modèle prédictif »[s]. Voici le problème philosophique central : le contrôle algorithmique de leur destin réduit les accusés à des profils plutôt qu’à des personnes, à des probabilités statistiques plutôt qu’à des individus dotés de droits.

Le vide réglementaire

Les services de police déploient ces technologies plus vite que les législateurs ne peuvent les comprendre. Le Dakota du Nord, où Lipps a été détenue à tort, ne dispose d’aucune législation encadrant l’utilisation de l’IA dans les enquêtes policières. Cet État incarne un « Far West réglementaire » où « toutes sortes de produits technologiques sont testés, avec un minimum de transparence »[s].

Ian Adams, professeur adjoint de criminologie à l’Université de Caroline du Sud, a déclaré à CNN que la police adopte l’IA « si rapidement que les services doivent se fier uniquement aux promesses des fournisseurs »[s]. Lorsque des erreurs surviennent, elles impliquent souvent à la fois des défaillances technologiques et humaines : des policiers qui s’en remettent aux résultats des ordinateurs plutôt que de mener une enquête de base. Dans le cas de Lipps, ses avocats ont indiqué que des relevés bancaires disculpatoires étaient facilement accessibles et que la reconnaissance faciale par IA avait été utilisée comme un raccourci pour éviter une enquête élémentaire.

Plus de 20 villes ont interdit totalement l’utilisation de la reconnaissance faciale par la police. Détroit, après un accord historique dans une affaire d’arrestation abusive, n’autorise plus les mandats d’arrêt basés uniquement sur la reconnaissance faciale et une séance d’identification par photos. L’Indiana a inscrit des protections similaires dans sa législation[s]. Mais ces mesures restent des exceptions, et de nombreuses juridictions n’ont pas de règles comparables.

À quoi pourrait ressembler une réforme

L’ACLU et des groupes de défense des libertés civiles réclament des exigences de transparence : des inventaires publics des outils d’IA, la divulgation obligatoire des preuves algorithmiques, et l’interdiction d’utiliser la reconnaissance faciale comme seule base pour une arrestation. Certains États ont commencé à réagir. L’Arizona a adopté des règles limitant l’utilisation de l’IA dans les tribunaux. Le Nevada a créé des lignes directrices pour les magistrats. L’Arkansas a interdit l’exposition des données judiciaires aux systèmes d’IA générative[s].

Mais la réglementation pourrait ne pas suffire. Le Minnesota Journal of Law and Inequality a conclu que les fournisseurs de police prédictive « ont créé des produits où la discrimination est une caractéristique, et non un bug »[s]. Les systèmes entraînés sur des données biaisées produiront des résultats biaisés, quelle que soit la rigueur de leur déploiement. La question est de savoir si les gains d’efficacité des algorithmes de police prédictive justifient leurs coûts constitutionnels, et si un système judiciaire qui réduit les personnes à des scores de probabilité peut encore être qualifié de juste.

Selon Biometric Update, les factures impayées après la détention de Lipps ont finalement entraîné la perte de sa maison, de sa voiture et de son chien[s]. Elle ne récupérera jamais ces cinq mois. « Je ne retournerai jamais dans le Dakota du Nord », a-t-elle déclaré aux médias locaux après sa libération la veille de Noël[s]. La reconnaissance faciale reste utilisée par la police malgré la liste croissante d’arrestations abusives documentées[s].

Angela Lipps, une résidente du Tennessee âgée de 50 ans, a été arrêtée le 14 juillet 2025 dans cet État sur la base d’un mandat d’arrêt délivré par le comté de Cass, dans le Dakota du Nord. Ce mandat, signé par un juge du Dakota du Nord le 1er juillet 2025, autorisait son extradition à l’échelle nationale pour plusieurs chefs d’accusation de crime, dont vol et utilisation non autorisée d’informations personnelles identifiantes[s].

Les accusations découlaient d’affaires de fraude bancaire dans la région de Fargo. Le département de police de West Fargo a soumis des images de surveillance à Clearview AI, un système de reconnaissance faciale disposant d’une base de données de milliards de photos collectées sur les réseaux sociaux et internet. Clearview a « identifié une suspecte potentielle présentant des traits similaires à ceux d’Angela Lipps », et West Fargo a partagé ce rapport avec la police de Fargo[s]. Les avocats de Lipps ont indiqué que les policiers n’avaient pas vérifié si elle s’était rendue ou avait séjourné dans le Dakota du Nord au moment des vols dans les banques. Ses relevés bancaires ont ensuite montré qu’elle se trouvait dans le Tennessee pendant les fraudes présumées.

Lipps a passé plus de trois mois en détention dans le Tennessee avant son extradition, puis a été transférée dans le Dakota du Nord, ce qui constituait son premier voyage en avion. Le 12 décembre 2025, le bureau du procureur a informé le détective de Fargo que la défense avait produit des « preuves potentiellement disculpatoires ». Les charges ont été abandonnées le 23 décembre, et Lipps a été libérée la veille de Noël. Selon Biometric Update, elle s’est retrouvée bloquée à Fargo sans argent pour rentrer chez elle[s][s]. Ses avocats estiment qu’il s’agit du « plus long cas de détention abusive liée à l’IA dans l’histoire des États-Unis »[s].

Algorithmes de police prédictive : ampleur de l’adoption

L’affaire Lipps illustre des défaillances systémiques dans le paysage en expansion de la police assistée par l’IA. Des chercheurs du Brennan Center rapportent que les services de police à travers le pays ont adopté des outils de fusion de données pilotés par l’IA pour compiler et analyser les informations, et que les nouveaux systèmes deviennent accessibles même aux départements moins bien dotés[s].

L’ACLU a documenté au moins 14 arrestations abusives attribuables à des erreurs d’identification par reconnaissance faciale :

- Nijeer Parks, Woodbridge, New Jersey (février 2019)

- Michael Oliver, Détroit, Michigan (juillet 2019)

- Robert Williams, Détroit, Michigan (janvier 2020)

- Christopher Gatlin, Saint-Louis, Missouri (août 2021)

- Alonzo Sawyer, Maryland (mars 2022)

- Randal Quran Reid, mandat délivré par la paroisse de Jefferson, Louisiane (novembre 2022)

- Porcha Woodruff, Détroit, Michigan (février 2023)

- Jason Killinger, Reno, Nevada (septembre 2023)

- Robert Dillion, Jacksonville Beach, Floride (août 2024)

- Javier Lorenzano-Nunez, Phoenix, Arizona (octobre 2024)

- Trevis Williams, New York (avril 2025)

- Angela Lipps, mandat délivré par Fargo, Dakota du Nord (juillet 2025)

- Beau Burgess, Orlando, Floride (août 2025)

- Kimberlee Williams, mandat délivré par le Maryland (juin 2021, affaire rendue publique en 2026)

Parmi les facteurs communs, on retrouve l’absence de vérification des alibis par la police, le traitement des correspondances algorithmiques comme des preuves définitives plutôt que comme des pistes d’enquête, et la distance géographique entre le lieu du crime présumé et le domicile de l’accusé[s].

Architecture technique des plateformes de fusion de données

Les algorithmes modernes de police prédictive fonctionnent grâce à des plateformes de fusion de données qui agrègent plusieurs flux de surveillance. Le Brennan Center for Justice a mis en avant des plateformes telles que NEXYTE « decision intelligence platform » de Cognyte, C3 AI Law Enforcement de C3.ai, la plateforme d’intégration de données pilotée par machine de Peregrine, et Nova public safety platform de Flock Safety[s].

Ces systèmes diffèrent fondamentalement des bases de données policières traditionnelles. « Alors que les bases de données policières traditionnelles fournissent aux services des informations que les agents peuvent évaluer pour élaborer une théorie ou parvenir à une conclusion, les outils modernes de fusion de données génèrent automatiquement des conclusions pour la police, sans contexte ni explication »[s].

Les données d’entrée incluent généralement : les dossiers d’arrestation, les données des lecteurs de plaques d’immatriculation, les correspondances de reconnaissance faciale, la surveillance des réseaux sociaux, les alertes de détection de coups de feu, les archives publiques, et les analyses vidéo issues des caméras corporelles, des caméras embarquées et des réseaux de surveillance fixes. Peregrine affirme que sa plateforme peut « intégrer des données de tout type, provenant de n’importe quelle source, à n’importe quelle échelle »[s].

Biais documentés dans les systèmes algorithmiques

L’étude Gender Shades de 2018, menée par Joy Buolamwini (MIT Media Lab) et Timnit Gebru (alors chez Microsoft Research), a testé des systèmes commerciaux de reconnaissance faciale et révélé des taux d’erreur de 0,8 % pour les hommes à la peau claire contre 34,7 % pour les femmes à la peau plus foncée, soit un écart de 1 à 40. Une étude du NIST en 2019 portant sur 189 algorithmes de reconnaissance faciale de 99 développeurs a montré que les visages afro-américains et asiatiques avaient 10 à 100 fois plus de risques d’être mal identifiés que les visages d’hommes blancs[s].

Pour les instruments d’évaluation des risques, l’enquête de ProPublica en 2016 sur COMPAS a révélé que la formule signalait à tort les accusés noirs comme futurs criminels à un taux près de deux fois supérieur à celui des accusés blancs. ProPublica a également rapporté qu’après contrôle des antécédents judiciaires, de la récidive, de l’âge et du genre, les accusés noirs avaient toujours plus de risques d’être considérés comme présentant un risque élevé[s].

L’analyse du Harvard Human Rights Journal de 2025 a identifié deux sources de biais racial dans les instruments actuariels d’évaluation des risques (ARAI) : « premièrement, ils incluent des facteurs d’entrée basés sur les normes de la blanchité, et deuxièmement, ils utilisent des facteurs de risque hautement racialisés comme les antécédents judiciaires ». Résultat : « des facteurs de risque en apparence neutres deviennent des proxys pernicieux de la race »[s].

Ce biais a des conséquences opérationnelles. Les ARAI « érodent le droit à la liberté en justifiant des peines indéterminées pour les individus jugés à haut risque », les minorités étant soumises à « une surveillance accrue, des peines plus sévères et une probabilité réduite d’obtenir une libération conditionnelle ou une caution, entraînant une privation de liberté bien plus grande »[s]. L’algorithme fonctionne comme une forme moderne de saisie de biens sans inculpation pénale, où c’est la liberté, et non les actifs, qui est retirée sur la base de probabilités.

Police prédictive et implications du Quatrième Amendement

Au-delà de la reconnaissance faciale réactive, les algorithmes de police prédictive sont déployés pour une surveillance prospective. Un rapport de la Brookings Institution a documenté un cas en Floride où un mineur a été « harcelé par les forces de l’ordre après qu’un algorithme a conclu qu’il était susceptible de commettre un crime ». Bien qu’il n’ait commis aucune infraction grave, « les policiers ont commencé à se rendre au domicile de ses parents sans prévenir pour l’interroger, parfois plusieurs fois par jour ». La famille a finalement déménagé pour échapper à ce harcèlement[s].

Le Minnesota Journal of Law and Inequality a observé que les fournisseurs de police prédictive « ont créé des produits où la discrimination est une caractéristique, et non un bug »[s]. Les systèmes entraînés sur des données historiques d’arrestation issues de communautés surpoliciées cibleront ces mêmes communautés pour des interventions futures, générant de nouvelles arrestations qui alourdiront encore davantage l’algorithme en faveur de ces communautés.

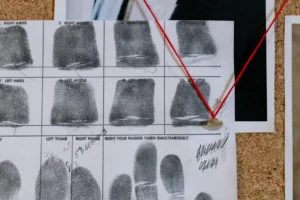

Biais d’automatisation et raccourcis d’enquête

Un facteur significatif dans les arrestations abusives est le « biais d’automatisation », cette tendance documentée des opérateurs humains à se fier aux résultats des ordinateurs. Des recherches montrent que les experts en empreintes digitales étaient influencés par l’ordre dans lequel les systèmes informatiques présentaient les correspondances potentielles. Dans les affaires de reconnaissance faciale, la police a traité les résultats algorithmiques comme des « correspondances à 100 % » ou utilisé des logiciels pour « identifier immédiatement et sans contestation » des suspects, malgré les avertissements des politiques internes stipulant que de tels résultats nécessitent une vérification indépendante[s].

Dans le cas de Lipps, le chef de la police de Fargo, Dave Zibolski, a reconnu que son département avait, sans le savoir, utilisé le système Clearview AI de West Fargo et « ne l’aurait pas autorisé ». Le département a depuis interdit l’utilisation du système d’IA de West Fargo et s’est engagé à effectuer des revues mensuelles de toutes les identifications par reconnaissance faciale[s].

Due process et préoccupations relatives à la dignité humaine

La Law Society of England and Wales a examiné les systèmes algorithmiques dans la justice pénale et a constaté « des défis importants en matière de biais, de discrimination, d’opacité et de respect du due process »[s].

Un commentaire de JURIST a identifié la tension constitutionnelle centrale : « De nombreux systèmes prédictifs fonctionnent comme des « boîtes noires » propriétaires, ce qui signifie que même les juges et les accusés peuvent ne pas comprendre pleinement comment un score de risque particulier a été produit. Lorsque la liberté est en jeu, une telle opacité devient profondément problématique »[s].

Le résultat réduit les accusés à de simples points de données au sein de modèles prédictifs. Par le biais du contrôle algorithmique de leur destin, les individus sont évalués « non pas principalement sur la base de leurs actions personnelles, mais à travers des schémas dérivés de grands ensembles de données »[s]. Cela constitue ce que les juristes décrivent comme des minorités réduites à des objets de gestion statistique plutôt que comme des sujets de droits.

Paysage réglementaire actuel

Le Dakota du Nord ne dispose d’aucune législation encadrant l’utilisation de l’IA dans les enquêtes policières[s]. Ce vide réglementaire est courant à l’échelle nationale.

Certaines juridictions ont agi :

- Plus de 20 villes ont interdit la reconnaissance faciale par la police

- Détroit interdit les mandats d’arrêt basés uniquement sur la reconnaissance faciale et une séance d’identification par photos (accord dans l’affaire Robert Williams)

- L’Indiana a inscrit dans sa législation des protections contre les mandats basés uniquement sur la reconnaissance faciale

- L’Arizona a adopté des règles limitant l’utilisation de l’IA dans les tribunaux (2024)

- Le Nevada a créé des lignes directrices pour les magistrats concernant l’IA (2025)

- L’Arkansas a interdit l’exposition des données judiciaires à l’IA générative (2025)

- Le Kerala, en Inde, a interdit aux magistrats d’utiliser l’IA pour la prise de décision ou le raisonnement juridique

Le gouvernement fédéral a classé des outils d’IA similaires comme ayant « des implications significatives pour les droits civils, les libertés civiles et la vie privée », nécessitant des garanties incluant la formation, des tests avant déploiement, des évaluations d’impact et un suivi continu[s].

La question fondamentale

La question de savoir si les gains d’efficacité des algorithmes de police prédictive justifient leurs coûts constitutionnels reste sans réponse. Les études indépendantes évaluant si ces outils contribuent de manière mesurable à la sécurité publique sont rares[s]. Ce qui est documenté, en revanche, c’est un schéma d’arrestations abusives, de résultats biaisés et d’opacité qui sape le jugement individualisé que le due process exige.

Les avocats d’Angela Lipps ont déclaré : « Les policiers savaient qu’Angela était résidente du Tennessee, et nous n’avons constaté aucune enquête de leur part pour déterminer si elle s’était rendue ou avait séjourné dans le Dakota du Nord au moment des vols dans les banques. Au lieu de cela, un policier a utilisé la reconnaissance faciale par IA comme raccourci pour éviter une enquête de base, entraînant la détention d’une femme innocente et son transfert à l’autre bout du pays pour répondre d’accusations sans aucun lien avec elle »[s].

La police de Fargo n’a pas présenté d’excuses directes. L’affaire reste « ouverte et active », avec la possibilité que les charges « soient réintroduites si une enquête supplémentaire le justifie »[s]. Selon Biometric Update, les factures impayées après sa détention ont finalement entraîné la perte de sa maison, de sa voiture et de son chien[s]. Elle envisage des recours pour violation de ses droits civils mais n’a pas encore engagé de poursuites. La technologie de reconnaissance faciale reste utilisée par la police malgré les cas documentés d’arrestations abusives[s].