El cuello de botella de los datos sintéticos de IA es uno de los problemas más trascendentales en la inteligencia artificial hoy en día. Cada modelo de lenguaje de IA importante, desde ChatGPT hasta Llama, fue construido consumiendo enormes cantidades de texto humano extraído de internet: libros, artículos, publicaciones en foros, documentos científicos. Pero ese suministro es finito. Los investigadores de Epoch AI estiman el stock total utilizable de texto público generado por humanos en aproximadamente 300 billones de tokens, y sus proyecciones sugieren que este stock probablemente será completamente consumido entre 2026 y 2032.[s] Cuando eso suceda, la industria enfrentará un ajuste de cuentas: reducir la escala o encontrar otra fuente de combustible.

El Cuello de Botella de los Datos Sintéticos Explicado

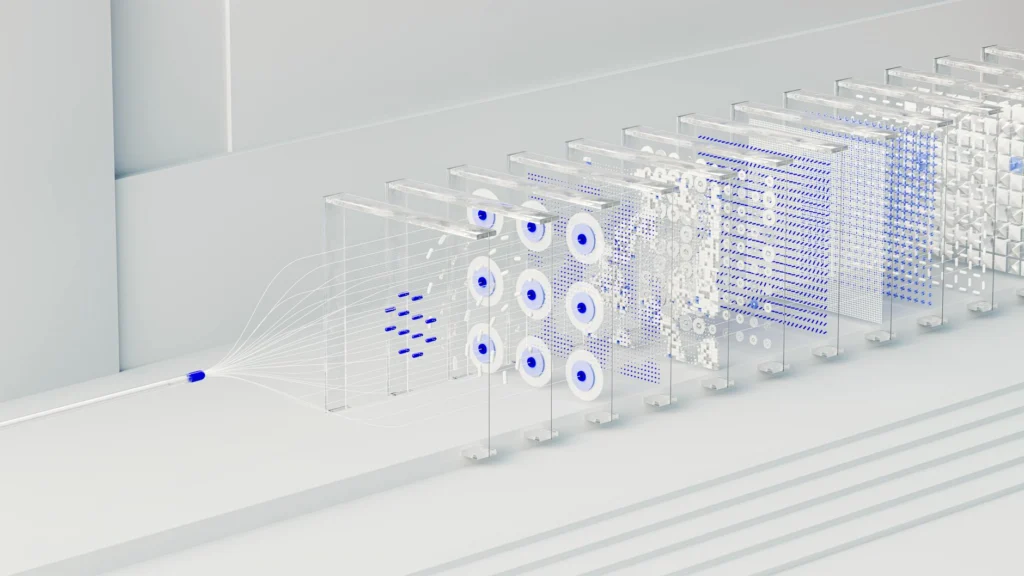

El escalamiento ha sido el motor principal del progreso de la IA durante la última década. Los modelos más grandes entrenados con más datos producen consistentemente mejores resultados. El Llama 3 de Meta, por ejemplo, fue entrenado con más de 15 billones de tokens, siete veces más que su predecesor.[s] Pero el apetito por los datos está creciendo más rápido de lo que los humanos pueden producirlos. Los datos de texto alimentados en modelos de IA han estado creciendo aproximadamente 2.5 veces por año, mientras que el poder computacional ha crecido cerca de 4 veces por año.[s]

«Hay un serio cuello de botella aquí», dijo Tamay Besiroglu, autor del estudio de Epoch AI. «Si empiezas a encontrar esas limitaciones sobre cuántos datos tienes, entonces ya no puedes escalar tus modelos de manera eficiente».[s]

Empeorando el cuello de botella de los datos sintéticos de IA, gran parte de la web ahora está cerrando activamente sus puertas. La Iniciativa de Proveniencia de Datos del MIT encontró que más del 28% de las fuentes más críticas en conjuntos de datos comunes de entrenamiento de IA han sido completamente restringidas vía robots.txt, con restricciones aumentando desde el otoño de 2023.[s] El pozo no solo se está agotando; está siendo tapado.

Cuando la IA se Alimenta de Sí Misma: Colapso del Modelo

La alternativa más obvia a los datos humanos son los datos sintéticos de IA: texto generado por los propios modelos de IA. Las empresas ya están haciendo esto. Elon Musk declaró en enero de 2025 que «la suma acumulativa del conocimiento humano se ha agotado en el entrenamiento de IA» y que los modelos han recurrido a información generada por IA para seguir mejorando.[s]

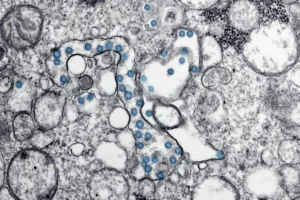

Pero entrenar IA con sus propios resultados tiene un problema fundamental. Un estudio histórico de 2024 publicado en Nature demostró que cuando los modelos de IA son entrenados con datos generados por modelos de IA anteriores, experimentan «colapso del modelo», un proceso degenerativo donde el modelo progresivamente olvida patrones raros y casos límite en el lenguaje humano.[s]

Piénsalo como fotocopiar una fotocopia. Nicolas Papernot, profesor asistente de ingeniería informática en la Universidad de Toronto, lo expresó simplemente: «Pierdes algo de la información». Peor aún, su investigación encontró que este proceso amplifica errores, sesgos e injusticias ya presentes en los datos.[s]

El resultado es que los modelos de lenguaje entrenados de esta manera comienzan a producir resultados sosos, repetitivos o francamente sin sentido. La diversidad de la expresión humana, lo raro, lo extraño, lo sorprendente, se va aplanando generación tras generación.

Dónde Funcionan Realmente los Datos Sintéticos

El cuello de botella de los datos sintéticos de IA no significa que todos los datos sintéticos de IA sean inútiles. En dominios estrechos y bien definidos, pueden funcionar brillantemente. El sistema AlphaGeometry de Google DeepMind generó 100 millones de ejemplos de entrenamiento sintéticos creando diagramas geométricos aleatorios y derivando exhaustivamente cada relación demostrable dentro de ellos.[s] El sistema resolvió 25 de 30 problemas de nivel olímpico de geometría, acercándose al rendimiento de un medallista de oro humano.

La diferencia crítica: los datos sintéticos de IA de AlphaGeometry eran verificables. Cada prueba generada podía ser verificada por un motor simbólico. No había ambigüedad sobre si los ejemplos de entrenamiento eran correctos. Por esto Epoch AI nota que los datos sintéticos de IA «solo han demostrado mejorar confiablemente las capacidades en dominios relativamente estrechos como matemáticas y programación».[s]

Para tareas generales de lenguaje, esa verificación es imposible. No hay un motor simbólico que pueda verificar si un párrafo de prosa es bueno, verdadero o interesante.

Lo Que Viene Después

La industria de la IA no se ha quedado sin opciones, pero ninguna de las alternativas son sustitutos limpios. Algunas empresas están persiguiendo acuerdos de licenciamiento con editores y plataformas para acceder a texto propietario. Otras están experimentando con aprendizaje de imágenes y video, aunque estas modalidades aún no han probado su valor para entrenar modelos de lenguaje a escala. También se exploran arquitecturas de mayor eficiencia capaces de alcanzar mejor rendimiento con menos datos de entrenamiento.

Sam Altman, CEO de OpenAI, ha reconocido directamente el cuello de botella de los datos sintéticos de IA: «Habría algo muy extraño si la mejor manera de entrenar un modelo fuera simplemente generar, digamos, un trillón de tokens de datos sintéticos de IA y alimentarlos de vuelta. De alguna manera eso parece ineficiente».[s]

Selena Deckelmann, directora de producto y tecnología de la Fundación Wikimedia, capturó la extrañeza del momento: «Es un problema interesante ahora mismo que estemos teniendo conversaciones sobre recursos naturales acerca de datos creados por humanos».[s]

El cuello de botella de los datos sintéticos de IA no es un riesgo futuro; es una restricción activa que está modelando cómo se construirá la próxima generación de modelos de IA. Los modelos que lo naveguen bien serán aquellos que encuentren maneras de usar los datos sintéticos de IA como un suplemento al conocimiento humano, no como un reemplazo para él.

El cuello de botella de los datos sintéticos de IA representa una restricción fundamental de escalamiento para los modelos de lenguaje grandes. El mecanismo central es directo: el rendimiento del modelo ha escalado confiablemente con el volumen de datos de entrenamiento, pero el reservorio de texto generado por humanos es finito y se está reduciendo. El análisis revisado por pares de Epoch AI estima el stock efectivo de texto humano público en aproximadamente 300 billones de tokens (90% CI: 100T a 1000T), considerando filtrado de calidad de datos y entrenamiento multi-época.[s] Su intervalo de confianza del 80% coloca la utilización completa entre 2026 y 2032.

El Cuello de Botella de los Datos Sintéticos en las Leyes de Escalamiento

La urgencia depende de qué tan agresivamente se sobreentrenan los modelos. El entrenamiento óptimo computacional (la receta Chinchilla de ~20 tokens por parámetro) agotaría el stock alrededor de 2028. Pero la práctica moderna favorece el sobreentrenamiento: el Llama 3 8B de Meta fue entrenado con 15 billones de tokens, aproximadamente 94 veces la cantidad óptima de Chinchilla para su conteo de parámetros.[s] Con sobreentrenamiento 5x, el stock se agota para 2027. Con 100x, ya podría haberse agotado.[s]

Agravando el cuello de botella de los datos sintéticos de IA está la restricción activa por parte de proveedores de contenido. La Iniciativa de Proveniencia de Datos del MIT documentó que el 28% de las fuentes más críticas en el conjunto de datos de entrenamiento C4 ahora están completamente restringidas vía robots.txt.[s] Esta contracción comenzó en serio en el otoño de 2023, cuando las principales empresas de IA comenzaron a documentar cadenas User-Agent específicas de rastreadores que los propietarios de contenido podían bloquear.

Colapso del Modelo: La Realidad Matemática

El documento de Nature 2024 por Shumailov et al. formalizó el fenómeno del colapso del modelo con rigor matemático.[s] El resultado central: cuando los modelos generativos son entrenados recursivamente con sus propios resultados, tres fuentes de error compuesto impulsan la degradación progresiva.

Primero, el error de aproximación estadística del muestreo finito causa que eventos de baja probabilidad (las «colas» de la distribución) estén subrepresentados y eventualmente se pierdan. Segundo, el error de expresividad funcional surge porque las redes neuronales solo son aproximadores universales en el límite de anchura infinita, introduciendo probabilidad no cero fuera del soporte de la distribución verdadera. Tercero, el error de aproximación funcional de procedimientos de optimización (sesgo SGD, elección de objetivo) se compone a través de generaciones.

Los autores probaron que para aproximaciones gaussianas, la distancia Wasserstein-2 entre el modelo de n-ésima generación y la distribución original diverge al infinito, mientras que la varianza colapsa a cero casi seguramente. En términos simples: la visión del modelo de la realidad se estrecha a un punto, perdiendo toda variación significativa. Demostraron este colapso en GMMs, VAEs y LLMs ajustados finamente.[s]

El documento identifica un argumento de estado absorbente para distribuciones discretas: cuando todas las muestras convergen a un solo valor, la cadena de Markov alcanza un estado absorbente (una función delta), y «con probabilidad 1, convergirá a uno de los estados absorbentes».[s] Esto no es un riesgo que la mejor ingeniería elimine; es una inevitabilidad matemática del autoentrenamiento recursivo sin datos humanos frescos.

Datos Sintéticos que Escapan del Cuello de Botella

No todos los datos sintéticos de IA desencadenan colapso. La variable clave es la verificabilidad. El AlphaGeometry de Google DeepMind generó 100 millones de pares sintéticos de teorema-prueba muestreando premisas geométricas aleatorias, ejecutando un motor de deducción simbólica para derivar todas las conclusiones alcanzables, luego usando retroceso para identificar pruebas mínimas.[s] Las pruebas resultantes eran verificables por máquina: cada paso seguía de reglas lógicas formales.

Este enfoque resolvió el cuello de botella de los datos sintéticos de IA para geometría explotando un dominio donde la corrección es decidible. El sistema resolvió 25 de 30 problemas de nivel IMO, comparado con 10 para el estado del arte anterior.[s] Se ha demostrado éxito similar en generación de código, donde los programas sintéticos pueden ser verificados por ejecución.

El patrón es claro: los datos sintéticos de IA funcionan cuando puedes filtrarlos o verificarlos contra la verdad fundamental. Para generación de lenguaje abierta, no existe tal oráculo. La evaluación de Epoch AI es directa: los datos sintéticos de IA «solo han demostrado mejorar confiablemente las capacidades en dominios relativamente estrechos como matemáticas y programación».[s]

Navegando la Restricción

Se están explorando varias estrategias para mitigar el cuello de botella de los datos sintéticos de IA. El subentrenamiento (aumentar parámetros mientras se mantiene fijo el tamaño del conjunto de datos) puede entregar el equivalente de hasta dos órdenes de magnitud adicionales de escalamiento óptimo computacional, pero eventualmente se estanca.[s] El entrenamiento multimodal en imágenes y video podría expandir el stock efectivo de datos, aunque el texto sigue siendo la modalidad principal para capacidades de vanguardia. Las mejoras en eficiencia de datos, incluyendo mejor tokenización, aprendizaje curricular y arquitecturas de mezcla de expertos, reducen los tokens necesarios por unidad de ganancia de capacidad.

El documento de Shumailov et al. ofrece una prescripción precisa: el acceso a la distribución original es crucial. Su marco de parámetros de mezcla muestra que el colapso puede ser mitigado manteniendo una proporción suficiente de datos humanos genuinos en cada generación de entrenamiento.[s] Esto hace del contenido auténtico generado por humanos un activo que se aprecia. Como concluyen los autores, «el valor de los datos recolectados sobre interacciones humanas genuinas con sistemas será cada vez más valioso».[s]

El cuello de botella de los datos sintéticos de IA no detendrá completamente el progreso de la IA. Pero remodelará la economía del campo, haciendo que los datos humanos de alta calidad sean una mercancía escasa y recompensando a las empresas que inviertan en estrategias de verificación, curación y generación de datos novedosos en lugar de escalamiento por fuerza bruta.