Der Synthetische-Daten-Engpass ist eines der folgenreichsten Probleme der künstlichen Intelligenz heute. Jedes große KI-Sprachmodell, von ChatGPT bis Llama, wurde durch den Verbrauch enormer Mengen menschlicher Texte aufgebaut, die aus dem Internet zusammengetragen wurden: Bücher, Artikel, Forenbeiträge, wissenschaftliche Arbeiten. Doch dieser Vorrat ist begrenzt. Forscher von Epoch AI schätzen den gesamten nutzbaren Bestand an öffentlich zugänglichen, von Menschen erstellten Texten auf etwa 300 Billionen Token. Ihre Prognosen deuten darauf hin, dass dieser Bestand zwischen 2026 und 2032 vollständig aufgebraucht sein wird.[s] Wenn dies eintritt, steht die Branche vor einer grundlegenden Entscheidung: zurückfahren oder eine andere Wissensquelle finden.

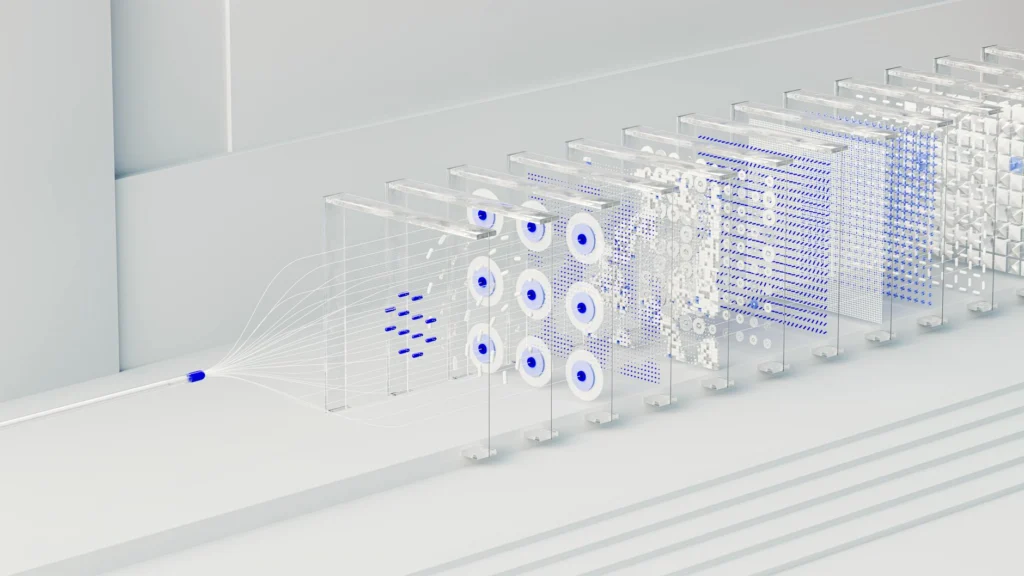

Der Synthetische-Daten-Engpass erklärt

Skalierung war das treibende Prinzip des KI-Fortschritts im letzten Jahrzehnt. Größere Modelle, die mit mehr Daten trainiert werden, liefern durchgehend bessere Ergebnisse. Metas Llama 3 wurde beispielsweise mit über 15 Billionen Token trainiert – siebenmal mehr als sein Vorgänger.[s] Doch der Datenhunger wächst schneller, als Menschen neue Inhalte produzieren können. Die Menge an Textdaten, die in KI-Modelle eingespeist wird, steigt jährlich um das 2,5-Fache, während die Rechenleistung etwa viermal so schnell wächst.[s]

„Hier gibt es einen ernsthaften Engpass“, sagte Tamay Besiroglu, Mitautor der Epoch-AI-Studie. „Wenn Sie an diese Grenzen stoßen, wie viel Daten Ihnen zur Verfügung stehen, können Sie Ihre Modelle nicht mehr effizient skalieren.“[s]

Den Synthetische-Daten-Engpass verschärft zudem, dass große Teile des Internets ihre Türen aktiv verschließen. Die MIT Data Provenance Initiative stellte fest, dass mehr als 28 Prozent der wichtigsten Quellen in gängigen KI-Trainingsdatensätzen über die robots.txt-Datei vollständig gesperrt wurden. Seit Herbst 2023 nehmen diese Einschränkungen rasant zu.[s] Die Quelle versiegt nicht nur – sie wird gezielt verschlossen.

Wenn KI sich selbst füttert: Modellkollaps

Die naheliegendste Alternative zu menschlichen Daten sind synthetische Daten: Texte, die von KI-Modellen selbst generiert werden. Unternehmen setzen dies bereits um. Elon Musk erklärte im Januar 2025, „die kumulative Summe des menschlichen Wissens sei für das KI-Training erschöpft“ und die Modelle griffen nun auf KI-generierte Informationen zurück, um sich weiterzuentwickeln.[s]

Doch das Training von KI mit ihren eigenen Ausgaben birgt ein grundlegendes Problem. Eine bahnbrechende Studie aus dem Jahr 2024, veröffentlicht in Nature, zeigte, dass KI-Modelle, die mit Daten früherer KI-Modelle trainiert werden, einem „Modellkollaps“ unterliegen – einem degenerativen Prozess, bei dem das Modell nach und nach seltene Muster und Sonderfälle der menschlichen Sprache vergisst.[s]

Man kann es sich wie das Kopieren einer Kopie vorstellen. Nicolas Papernot, Assistenzprofessor für Computertechnik an der Universität Toronto, brachte es auf den Punkt: „Man verliert dabei Informationen.“ Schlimmer noch: Seine Forschung zeigte, dass dieser Prozess Fehler, Verzerrungen und Ungerechtigkeiten in den Daten verstärkt.[s]

Das Ergebnis: Sprachmodelle, die auf diese Weise trainiert werden, produzieren zunehmend eintönige, repetitive oder sogar unsinnige Ausgaben. Die Vielfalt des menschlichen Ausdrucks – das Ungewöhnliche, Seltene, Überraschende – wird von Generation zu Generation glattgebügelt.

Wo synthetische Daten tatsächlich funktionieren

Der Synthetische-Daten-Engpass bedeutet nicht, dass alle synthetischen Daten nutzlos sind. In engen, klar definierten Bereichen können sie hervorragend funktionieren. Googles DeepMind-System AlphaGeometry generierte 100 Millionen synthetische Trainingsbeispiele, indem es zufällige geometrische Diagramme erstellte und alle beweisbaren Beziehungen darin systematisch ableitete.[s] Das System löste 25 von 30 Aufgaben der Mathematik-Olympiade und erreichte damit fast das Niveau eines menschlichen Goldmedaillengewinners.

Der entscheidende Unterschied: Die synthetischen Daten von AlphaGeometry waren überprüfbar. Jeder generierte Beweis konnte von einer symbolischen Engine verifiziert werden. Es gab keine Zweifel, ob die Trainingsbeispiele korrekt waren. Deshalb stellt Epoch AI fest, dass synthetische Daten „nur in relativ engen Bereichen wie Mathematik und Programmierung nachweislich zuverlässig die Fähigkeiten verbessern“ können.[s]

Für allgemeine Sprachaufgaben ist diese Überprüfung unmöglich. Es gibt keine symbolische Engine, die beurteilen kann, ob ein Prosatext gut, wahr oder interessant ist.

Was kommt als Nächstes?

Der KI-Branche gehen die Optionen nicht aus, doch keine der Alternativen ist ein sauberer Ersatz. Einige Unternehmen verfolgen Lizenzvereinbarungen mit Verlagen und Plattformen, um Zugang zu proprietären Texten zu erhalten. Andere experimentieren mit dem Lernen aus Bildern und Videos, doch diese Modalitäten haben sich für das Training von Sprachmodellen im großen Maßstab noch nicht bewährt.

Sam Altman, CEO von OpenAI, hat den Synthetische-Daten-Engpass direkt angesprochen: „Es wäre schon sehr seltsam, wenn der beste Weg, ein Modell zu trainieren, darin bestünde, einfach eine Billiarde Token synthetischer Daten zu generieren und diese wieder einzuspeisen. Irgendwie scheint das ineffizient.“[s]

Selena Deckelmann, Chief Product and Technology Officer der Wikimedia Foundation, brachte die Absurdität der Situation auf den Punkt: „Es ist ein interessantes Problem, dass wir jetzt über menschlich erstellte Daten wie über natürliche Ressourcen sprechen.“[s]

Der Synthetische-Daten-Engpass ist keine zukünftige Gefahr, sondern eine aktive Beschränkung, die bereits jetzt die Entwicklung der nächsten KI-Modellgeneration prägt. Die Modelle, die ihn am besten meistern, werden die sein, die Wege finden, synthetische Daten als Ergänzung – nicht als Ersatz – für menschliches Wissen zu nutzen.

Der Synthetische-Daten-Engpass stellt eine grundlegende Skalierungsbeschränkung für große Sprachmodelle dar. Der Kernmechanismus ist einfach: Die Leistung von Modellen skaliert zuverlässig mit dem Trainingsdatenvolumen, doch der Vorrat an menschlich generierten Texten ist endlich und schrumpft. Die peer-reviewte Analyse von Epoch AI schätzt den effektiven Bestand an öffentlich zugänglichen, menschlichen Texten auf etwa 300 Billionen Token (90 %-Konfidenzintervall: 100 Billionen bis 1 Billiarde), unter Berücksichtigung von Qualitätsfiltern und Mehrfachtraining.[s] Ihr 80 %-Konfidenzintervall geht von einer vollständigen Ausschöpfung zwischen 2026 und 2032 aus.

Der Synthetische-Daten-Engpass in Skalierungsgesetzen

Die Dringlichkeit hängt davon ab, wie aggressiv Modelle übertrainiert werden. Ein rechnerisch optimales Training (nach dem Chinchilla-Rezept von etwa 20 Token pro Parameter) würde den Bestand um 2028 erschöpfen. Doch die moderne Praxis bevorzugt Übertraining: Metas Llama 3 mit 8 Milliarden Parametern wurde mit 15 Billionen Token trainiert – etwa 94-mal mehr als die Chinchilla-optimale Menge für seine Parameterzahl.[s] Bei fünffachem Übertraining ist der Bestand bis 2027 aufgebraucht. Bei 100-fachem Übertraining könnte er bereits erschöpft sein.[s]

Den Synthetische-Daten-Engpass verschärft zudem die aktive Einschränkung durch Inhalteanbieter. Die MIT Data Provenance Initiative dokumentierte, dass 28 Prozent der wichtigsten Quellen im C4-Trainingsdatensatz nun über robots.txt vollständig gesperrt sind.[s] Diese Verknappung begann im Herbst 2023 ernsthaft, als große KI-Unternehmen damit begannen, crawler-spezifische User-Agent-Strings zu dokumentieren, die Inhalteanbieter blockieren konnten.

Modellkollaps: Die mathematische Realität

Die Nature-Studie von Shumailov et al. aus dem Jahr 2024 formalisierte das Phänomen des Modellkollapses mit mathematischer Präzision.[s] Das zentrale Ergebnis: Wenn generative Modelle rekursiv mit ihren eigenen Ausgaben trainiert werden, treiben drei sich verstärkende Fehlerquellen die progressive Verschlechterung voran.

Erstens führt der statistische Approximationsfehler durch endliche Stichproben dazu, dass Ereignisse mit geringer Wahrscheinlichkeit (die „Ränder“ der Verteilung) unterrepräsentiert sind und schließlich verloren gehen. Zweitens entsteht ein funktionaler Expressivitätsfehler, weil neuronale Netze nur im Grenzfall unendlicher Breite universelle Approximatoren sind, was zu einer nicht-null Wahrscheinlichkeit außerhalb des Trägers der wahren Verteilung führt. Drittens verstärkt sich der funktionale Approximationsfehler durch Optimierungsverfahren (SGD-Bias, Wahl der Zielfunktion) über Generationen hinweg.

Die Autoren bewiesen, dass für Gaußsche Approximationen der Wasserstein-2-Abstand zwischen dem n-ten Generationsmodell und der ursprünglichen Verteilung gegen unendlich divergiert, während die Varianz fast sicher gegen null kollabiert. Einfach ausgedrückt: Die Sicht des Modells auf die Realität verengt sich zu einem Punkt und verliert jede sinnvolle Variation. Sie demonstrierten diesen Kollaps in GMMs, VAEs und feinabgestimmten LLMs.[s]

Die Studie identifiziert ein Absorptionszustands-Argument für diskrete Verteilungen: Wenn alle Stichproben zu einem einzigen Wert konvergieren, erreicht die Markov-Kette einen Absorptionszustand (eine Delta-Funktion), und „mit Wahrscheinlichkeit 1 wird sie zu einem der Absorptionszustände konvergieren.“[s] Dies ist kein Risiko, das durch bessere Technik beseitigt werden kann; es ist eine mathematische Unvermeidbarkeit des rekursiven Selbsttrainings ohne frische menschliche Daten.

Synthetische Daten, die den Engpass umgehen

Nicht alle synthetischen Daten lösen einen Kollaps aus. Die entscheidende Variable ist die Überprüfbarkeit. Googles DeepMind-System AlphaGeometry generierte 100 Millionen synthetische Theorem-Beweis-Paare, indem es zufällige geometrische Prämissen abtastete, eine symbolische Deduktionsengine ausführte, um alle erreichbaren Schlussfolgerungen abzuleiten, und dann durch Rückverfolgung minimale Beweise identifizierte.[s] Die resultierenden Beweise waren maschinenverifizierbar: Jeder Schritt folgte aus formalen logischen Regeln.

Dieser Ansatz löste den Synthetische-Daten-Engpass für die Geometrie, indem er einen Bereich nutzte, in dem Korrektheit entscheidbar ist. Das System löste 25 von 30 IMO-Aufgaben, verglichen mit 10 für den bisherigen Stand der Technik.[s] Ähnliche Erfolge wurden in der Codegenerierung gezeigt, wo synthetische Programme durch Ausführung verifiziert werden können.

Das Muster ist klar: Synthetische Daten funktionieren, wenn sie gegen eine Grundwahrheit gefiltert oder verifiziert werden können. Für offene Sprachgenerierung existiert kein solches Orakel. Die Einschätzung von Epoch AI ist direkt: Synthetische Daten „haben sich nur in relativ engen Bereichen wie Mathematik und Programmierung als zuverlässig erwiesen, um die Fähigkeiten zu verbessern.“[s]

Den Engpass navigieren

Mehrere Strategien werden erforscht, um den Synthetische-Daten-Engpass abzumildern. Untertraining (Vergrößerung der Parameter bei gleichbleibender Datensatzgröße) kann das Äquivalent von bis zu zwei zusätzlichen Größenordnungen rechnerisch optimaler Skalierung liefern, stößt jedoch irgendwann an Grenzen.[s] Multimodales Training mit Bildern und Videos könnte den effektiven Datenbestand erweitern, doch Text bleibt die primäre Modalität für Spitzenfähigkeiten. Verbesserungen der Dateneffizienz, einschließlich besserer Tokenisierung, Curriculum-Learning und Mixture-of-Experts-Architekturen, reduzieren die benötigten Token pro Fähigkeitseinheit.

Die Studie von Shumailov et al. bietet eine präzise Empfehlung: Der Zugang zur ursprünglichen Verteilung ist entscheidend. Ihr Mischparameter-Rahmen zeigt, dass der Kollaps gemildert werden kann, indem in jeder Trainingsgeneration ein ausreichender Anteil echter menschlicher Daten erhalten bleibt.[s] Dadurch wird authentischer, menschlich generierter Inhalt zu einem wertvolleren Gut. Wie die Autoren schlussfolgern: „Der Wert von Daten, die echte menschliche Interaktionen mit Systemen dokumentieren, wird zunehmend wertvoller werden.“[s]

Der Synthetische-Daten-Engpass wird den KI-Fortschritt nicht vollständig stoppen. Doch er wird die Ökonomie des Feldes neu gestalten, hochwertige menschliche Daten zu einer knappen Ressource machen und Unternehmen belohnen, die in Verifizierung, Kuratierung und neuartige Datengenerierungsstrategien investieren – statt in brute-force-Skalierung.