Le goulot d’étranglement des données synthétiques représente l’un des défis les plus critiques de l’intelligence artificielle aujourd’hui. Chaque grand modèle de langage, de ChatGPT à Llama, a été construit en consommant d’énormes quantités de textes humains collectés sur Internet : livres, articles, messages de forums, publications scientifiques. Mais cette ressource est limitée. Des chercheurs d’Epoch AI estiment que le stock total de textes publics générés par l’humain s’élève à environ trois cents billions de jetons, et leurs projections indiquent que cette réserve sera probablement épuisée entre deux mille vingt-six et deux mille trente-deux[s]. Quand ce moment arrivera, l’industrie devra faire un choix : réduire l’échelle, ou trouver une autre source de carburant.

Comprendre le goulot d’étranglement des données synthétiques

La montée en puissance a été le moteur principal des progrès de l’IA au cours de la dernière décennie. Des modèles plus grands, entraînés sur davantage de données, produisent systématiquement de meilleurs résultats. Meta a par exemple entraîné Llama 3 sur plus de quinze billions de jetons, soit sept fois plus que son prédécesseur[s]. Mais l’appétit pour les données croît plus vite que la capacité humaine à en produire. Le volume de textes injectés dans les modèles d’IA a augmenté d’environ deux virgule cinq fois par an, tandis que la puissance de calcul a progressé d’environ quatre fois par an[s].

« Il y a un véritable goulot d’étranglement ici, a déclaré Tamay Besiroglu, coauteur de l’étude d’Epoch AI. Si vous commencez à buter sur ces limites de données disponibles, vous ne pouvez plus vraiment faire évoluer vos modèles de manière efficace. »[s]

Pour aggraver le goulot d’étranglement des données synthétiques, une grande partie du web ferme désormais ses portes. L’initiative Data Provenance du Massachusetts Institute of Technology a révélé que plus de vingt-huit pour cent des sources les plus critiques dans les jeux de données d’entraînement courants sont désormais totalement bloquées via le fichier robots.txt, avec une explosion des restrictions depuis l’automne deux mille vingt-trois[s]. Le puits ne se tarit pas seulement : il est en train d’être bouché.

Quand l’IA se nourrit d’elle-même : l’effondrement des modèles

L’alternative la plus évidente aux données humaines est l’utilisation de données synthétiques, c’est-à-dire de textes générés par les modèles d’IA eux-mêmes. Les entreprises s’y mettent déjà. En janvier deux mille vingt-cinq, Elon Musk a déclaré que « la somme cumulative des connaissances humaines a été épuisée pour l’entraînement de l’IA » et que les modèles se tournent désormais vers des informations générées par l’IA pour continuer à progresser[s].

Mais entraîner une IA sur ses propres productions pose un problème fondamental. Une étude marquante publiée en deux mille vingt-quatre dans la revue *Nature* a démontré que lorsque les modèles d’IA sont entraînés sur des données générées par des modèles précédents, ils subissent un « effondrement des modèles », un processus dégénératif où le modèle oublie progressivement les schémas rares et les cas particuliers du langage humain[s].

Imaginez photocopier une photocopie. Nicolas Papernot, professeur adjoint en génie informatique à l’Université de Toronto, l’explique simplement : « Vous perdez une partie de l’information. » Pire encore, ses recherches ont montré que ce processus amplifie les erreurs, les biais et les injustices déjà présents dans les données[s].

Le résultat est que les modèles de langage entraînés de cette manière commencent à produire des sorties fades, répétitives, voire totalement absurdes. La diversité de l’expression humaine, le bizarre, le rare, le surprenant, s’efface génération après génération.

Les domaines où les données synthétiques fonctionnent vraiment

Le goulot d’étranglement des données synthétiques ne signifie pas que toutes les données synthétiques sont inutiles. Dans des domaines étroits et bien définis, elles peuvent se révéler extrêmement efficaces. Le système AlphaGeometry de Google DeepMind a généré cent millions d’exemples d’entraînement synthétiques en créant des diagrammes géométriques aléatoires et en dérivant de manière exhaustive toutes les relations démontrables qu’ils contenaient[s]. Le système a résolu vingt-cinq des trente problèmes de niveau olympique en géométrie, approchant les performances d’un médaillé d’or humain.

La différence cruciale : les données synthétiques d’AlphaGeometry étaient vérifiables. Chaque démonstration générée pouvait être contrôlée par un moteur symbolique. Il n’y avait aucune ambiguïté quant à la validité des exemples d’entraînement. C’est pourquoi Epoch AI souligne que les données synthétiques « n’ont démontré leur capacité à améliorer les performances de manière fiable que dans des domaines relativement étroits comme les mathématiques et la programmation »[s].

Pour les tâches linguistiques générales, cette vérification est impossible. Il n’existe pas de moteur symbolique capable de déterminer si un paragraphe est bon, vrai ou intéressant.

Et maintenant ?

L’industrie de l’IA n’est pas à court d’options, mais aucune des alternatives n’est un substitut parfait. Certaines entreprises négocient des accords de licence avec des éditeurs et des plateformes pour accéder à des textes propriétaires. D’autres expérimentent l’apprentissage à partir d’images et de vidéos, bien que ces modalités n’aient pas encore prouvé leur valeur pour entraîner des modèles de langage à grande échelle.

Sam Altman, le directeur général d’OpenAI, a reconnu directement le goulot d’étranglement des données synthétiques : « Il y aurait quelque chose de très étrange si la meilleure façon d’entraîner un modèle était de générer, disons, un quadrillion de jetons de données synthétiques et de les réinjecter. D’une certaine manière, cela semble inefficace. »[s]

Selena Deckelmann, directrice des produits et de la technologie à la Wikimedia Foundation, a résumé l’étrangeté de la situation : « C’est un problème intéressant que nous ayons aujourd’hui des discussions sur les ressources naturelles à propos des données créées par l’humain. »[s]

Le goulot d’étranglement des données synthétiques n’est pas un risque futur ; c’est une contrainte active qui façonne déjà la construction de la prochaine génération de modèles d’IA. Ceux qui sauront le surmonter seront ceux qui trouveront des moyens d’utiliser les données synthétiques comme un complément aux connaissances humaines, et non comme un remplacement.

Le goulot d’étranglement des données synthétiques représente une contrainte fondamentale pour la montée en puissance des grands modèles de langage. Le mécanisme de base est simple : les performances des modèles évoluent de manière fiable avec le volume de données d’entraînement, mais le réservoir de textes générés par l’humain est fini et se réduit. L’analyse revue par les pairs d’Epoch AI estime le stock effectif de textes publics humains à environ trois cents billions de jetons, avec un intervalle de confiance à quatre-vingt-dix pour cent compris entre cent et mille billions, en tenant compte du filtrage de qualité et de l’entraînement multi-époques[s]. Leur intervalle de confiance à quatre-vingts pour cent situe l’épuisement total entre deux mille vingt-six et deux mille trente-deux.

Le goulot d’étranglement des données synthétiques dans les lois d’échelle

L’urgence dépend de l’intensité de la surutilisation des modèles. Un entraînement optimal en termes de calcul, selon la recette Chinchilla d’environ vingt jetons par paramètre, épuiserait le stock vers deux mille vingt-huit. Mais la pratique actuelle privilégie la surutilisation : le modèle Llama 3 huit milliards de Meta a été entraîné sur quinze billions de jetons, soit environ quatre-vingt-quatorze fois la quantité optimale Chinchilla pour son nombre de paramètres[s]. À cinq fois la surutilisation, le stock s’épuise d’ici deux mille vingt-sept. À cent fois, il pourrait déjà être épuisé[s].

Le goulot d’étranglement des données synthétiques est aggravé par les restrictions actives des fournisseurs de contenu. L’initiative Data Provenance du Massachusetts Institute of Technology a documenté que vingt-huit pour cent des sources les plus critiques du jeu de données d’entraînement C4 sont désormais totalement bloquées via le fichier robots.txt[s]. Cette contraction a véritablement commencé à l’automne deux mille vingt-trois, lorsque les grandes entreprises d’IA ont commencé à documenter des chaînes User-Agent spécifiques aux robots que les propriétaires de contenu pouvaient bloquer.

Effondrement des modèles : la réalité mathématique

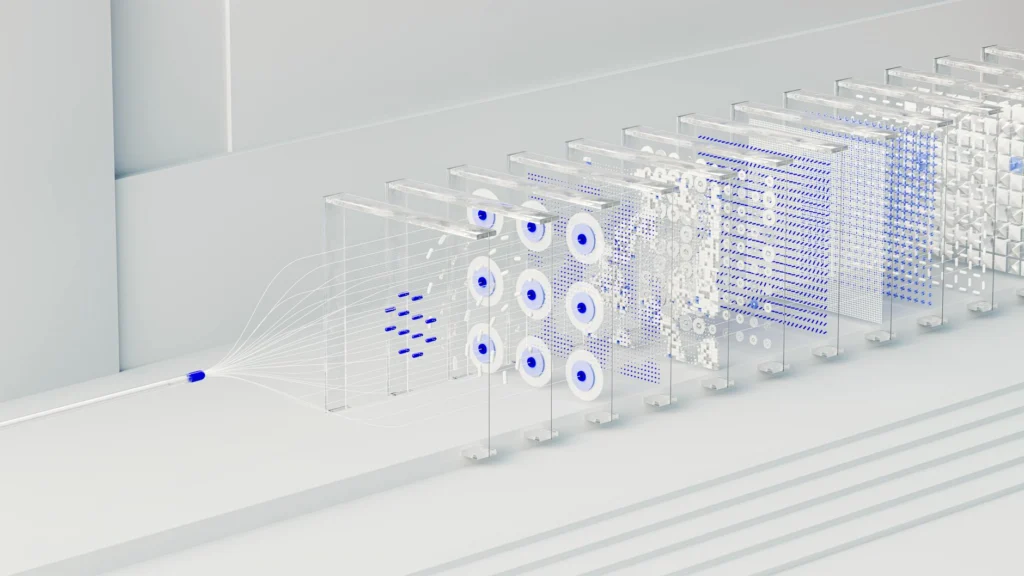

L’article de deux mille vingt-quatre publié dans *Nature* par Shumailov et ses collègues a formalisé le phénomène d’effondrement des modèles avec une rigueur mathématique[s]. Le résultat central : lorsque des modèles génératifs sont entraînés de manière récursive sur leurs propres sorties, trois sources d’erreurs cumulatives entraînent une dégradation progressive.

Premièrement, l’erreur d’approximation statistique due à l’échantillonnage fini fait que les événements de faible probabilité, situés dans les « queues » de la distribution, sont sous-représentés et finissent par disparaître. Deuxièmement, l’erreur d’expressivité fonctionnelle survient parce que les réseaux de neurones ne sont des approximateurs universels qu’à la limite d’une largeur infinie, introduisant une probabilité non nulle en dehors du support de la distribution réelle. Troisièmement, l’erreur d’approximation fonctionnelle liée aux procédures d’optimisation, comme le biais de la descente de gradient stochastique ou le choix de la fonction objectif, se cumule au fil des générations.

Les auteurs ont démontré que, pour des approximations gaussiennes, la distance de Wasserstein-2 entre le modèle de la n-ième génération et la distribution originale diverge vers l’infini, tandis que la variance s’effondre presque sûrement vers zéro. En termes simples : la vision de la réalité du modèle se rétrécit jusqu’à un point, perdant toute variation significative. Ils ont observé cet effondrement dans des modèles de mélange gaussiens, des auto-encodeurs variationnels et des grands modèles de langage affinés[s].

L’article identifie un argument d’état absorbant pour les distributions discrètes : lorsque tous les échantillons convergent vers une seule valeur, la chaîne de Markov atteint un état absorbant, une fonction delta, et « avec une probabilité de un, elle convergera vers l’un des états absorbants »[s]. Ce n’est pas un risque que l’ingénierie peut éliminer ; c’est une fatalité mathématique de l’auto-entraînement récursif sans apport de nouvelles données humaines.

Les données synthétiques qui échappent au goulot d’étranglement

Toutes les données synthétiques ne déclenchent pas l’effondrement. La variable clé est la vérifiabilité. AlphaGeometry de Google DeepMind a généré cent millions de paires théorème-démonstration synthétiques en échantillonnant des prémisses géométriques aléatoires, en exécutant un moteur de déduction symbolique pour dériver toutes les conclusions accessibles, puis en utilisant un retour en arrière pour identifier les démonstrations minimales[s]. Les démonstrations résultantes étaient vérifiables par machine : chaque étape découlait de règles logiques formelles.

Cette approche a résolu le goulot d’étranglement des données synthétiques pour la géométrie en exploitant un domaine où la justesse est décidable. Le système a résolu vingt-cinq des trente problèmes de niveau olympique, contre dix pour l’état de l’art précédent[s]. Un succès similaire a été démontré en génération de code, où les programmes synthétiques peuvent être vérifiés par exécution.

Le schéma est clair : les données synthétiques fonctionnent lorsque l’on peut les filtrer ou les vérifier par rapport à une vérité de référence. Pour la génération de langage ouvert, un tel oracle n’existe pas. L’évaluation d’Epoch AI est directe : les données synthétiques « n’ont démontré leur capacité à améliorer les performances de manière fiable que dans des domaines relativement étroits comme les mathématiques et la programmation »[s].

Naviguer dans cette contrainte

Plusieurs stratégies sont explorées pour atténuer le goulot d’étranglement des données synthétiques. Le sous-entraînement, qui consiste à augmenter le nombre de paramètres tout en maintenant la taille du jeu de données fixe, peut offrir l’équivalent de jusqu’à deux ordres de grandeur supplémentaires de mise à l’échelle optimale en termes de calcul, mais finit par atteindre un plateau[s]. L’entraînement multimodal sur des images et des vidéos pourrait élargir le stock effectif de données, bien que le texte reste la modalité principale pour les capacités de pointe. Les améliorations de l’efficacité des données, incluant une meilleure tokenisation, l’apprentissage par curriculum et les architectures de type mélange d’experts, réduisent le nombre de jetons nécessaires par unité de gain de capacité.

L’article de Shumailov et ses collègues propose une prescription précise : l’accès à la distribution originale est crucial. Leur cadre de paramètre de mélange montre que l’effondrement peut être atténué en maintenant une proportion suffisante de données humaines authentiques à chaque génération d’entraînement[s]. Cela fait des contenus générés par l’humain un actif en appréciation. Comme le concluent les auteurs, « la valeur des données collectées sur les interactions authentiques des humains avec les systèmes sera de plus en plus précieuse »[s].

Le goulot d’étranglement des données synthétiques n’arrêtera pas complètement les progrès de l’IA. Mais il va remodeler l’économie du secteur, faisant des données humaines de haute qualité une ressource rare et récompensant les entreprises qui investissent dans la vérification, la curation et des stratégies innovantes de génération de données, plutôt que dans une montée en puissance brutale.