Opinion.

Las herramientas de detección de IA están ahora integradas en universidades, redacciones y procesos de contratación en todo el mundo. GPTZero, ZeroGPT, Originality.ai y sus competidores prometen distinguir la escritura humana de la producción automatizada con precisión científica. No pueden. Lo que realmente detectan es un tipo específico de regularidad estadística que correlaciona más fuertemente con una prosa clara y estructurada que con la inteligencia artificial. El resultado es un sistema que castiga la buena escritura y señala desproporcionadamente a los hablantes no nativos de inglés, sin ofrecer una metodología revisada por pares ni un recuento honesto de su tasa de error.

La afirmación central de estas herramientas se basa en dos métricas: perplejidad y variabilidad (burstiness). La perplejidad mide cuán predecible es un texto para un modelo de lenguaje. Baja perplejidad significa que el modelo encuentra el texto poco sorprendente; alta perplejidad significa que el texto contiene elecciones léxicas inesperadas. La variabilidad mide la fluctuación de esa predictibilidad a lo largo de un documento: palabras y frases sorprendentes intercaladas indican alta variabilidad. La teoría sostiene que la IA genera texto con perplejidad y variabilidad consistentemente bajas (prosa fluida y predecible), mientras que la escritura humana es más desordenada, más variada, más sorprendente.

Esto suena razonable hasta que se considera qué mide realmente. Un texto con baja perplejidad no es necesariamente generado por una máquina. Es un texto que usa vocabulario común, gramática convencional y estructuras de oraciones directas. En la práctica, es prosa bien organizada y claramente escrita. Un artículo académico con un argumento lógico y lenguaje preciso se clasificará como más «similar a la IA» que una publicación de foro divagante llena de erratas y fragmentos de oraciones. El detector no identifica una máquina. Identifica un patrón que los humanos inventaron mucho antes de que existiera la IA.

El sesgo contra los hablantes no nativos de inglés

En 2023, investigadores de la Universidad de Stanford publicaron un estudio en la revista Patterns que debería haber puesto fin al debate sobre las herramientas de detección de IA en entornos educativos. Weixin Liang y sus colegas probaron siete detectores GPT populares con ensayos escritos por hablantes nativos y no nativos de inglés. Los detectores identificaron correctamente los ensayos de hablantes nativos como escritos por humanos casi en todos los casos. Pero clasificaron más del 61 % de los ensayos del TOEFL, escritos por estudiantes reales no angloparlantes, como generados por IA. Casi todos los 91 ensayos del TOEFL (97 %) fueron señalados por al menos un detector. Dieciocho ensayos fueron identificados unánimemente como generados por IA por las siete herramientas.

El mecanismo es directo. Los escritores no nativos de inglés tienden a usar vocabulario más simple, oraciones más cortas y estructuras gramaticales más convencionales. Evitan los modismos y la incrustación de cláusulas complejas porque son las características más difíciles de adquirir de un idioma. Esto produce exactamente el tipo de texto con baja perplejidad y baja variabilidad que los detectores interpretan como producción automatizada. El detector no sabe ni le importa si un ser humano se sentó en un escritorio y eligió esas palabras cuidadosamente en un segundo idioma. Ve regularidad estadística y la llama artificial.

Esto no es un problema menor de calibración. En universidades que usan herramientas de detección de IA para filtrar los trabajos de los estudiantes, un hablante no nativo de inglés que escribe cuidadosa y correctamente en su segunda lengua tiene estadísticamente más probabilidades de ser acusado de hacer trampa que un hablante nativo que entrega un trabajo descuidado y sin revisar. La herramienta no detecta deshonestidad. Detecta la huella lingüística de alguien que aprendió inglés de los libros de texto y no desde el nacimiento.

La Constitución estadounidense es aparentemente generada por IA

ZeroGPT, una de las herramientas gratuitas de detección más utilizadas, clasificó el 92 % de la Constitución de los Estados Unidos como generada por IA. La Biblia ha producido resultados similares. Resúmenes de casos judiciales de los años 1990, décadas antes de la existencia de los grandes modelos de lenguaje, han sido clasificados como probablemente escritos por una máquina. No son casos extremos ni entradas adversariales diseñadas para romper el sistema. Son textos sencillos, escritos en inglés formal, con el tipo de claridad estructural que los detectores interpretan como no humano.

Esto debería ser descalificante. Una herramienta que no puede distinguir entre el documento fundacional de una democracia y una producción de ChatGPT no detecta IA. Detecta formalidad. Detecta coherencia. Detecta un artefacto de compresión de su propia metodología, no una propiedad del origen del texto.

Sin metodología revisada por pares, sin tasas de error divulgadas

Las empresas detrás de las herramientas de detección de IA publican cifras de precisión que suenan impresionantes en materiales de marketing: 99 % de precisión, 98 % de exactitud. Estos números provienen de pruebas internas, realizadas con conjuntos de datos que las empresas seleccionan y controlan. Las evaluaciones independientes cuentan una historia diferente. El propio clasificador de OpenAI, por admisión de la empresa, identificaba correctamente solo el 26 % del texto generado por IA, mientras señalaba incorrectamente el 9 % del texto humano como escrito por una máquina. Otros detectores no han dado mejores resultados en pruebas independientes, con tasas de falsos positivos que varían ampliamente según el género textual y el estilo de escritura.

Ninguna herramienta importante de detección de IA ha sometido su metodología central a una revisión independiente por pares. Los modelos propietarios son cajas negras. Los usuarios no pueden inspeccionar el umbral de decisión, no pueden entender por qué un texto específico fue señalado, y no pueden apelar significativamente un resultado. Cuando una universidad usa estas herramientas para adjudicar casos de integridad académica, está externalizando un juicio trascendental a un producto comercial cuya lógica interna es secreta y cuya tasa de error está, en el mejor de los casos, pobremente caracterizada.

Compare esto con otras herramientas forenses utilizadas en decisiones de alto impacto. El análisis de ADN tiene tasas de error publicadas, protocolos estandarizados y décadas de validación por pares. Incluso el análisis de huellas dactilares, a pesar de sus limitaciones conocidas, opera bajo estándares publicados. Las herramientas de detección de IA piden ser tratadas con la misma autoridad epistémica sin proporcionar ninguna de las mismas garantías de responsabilidad.

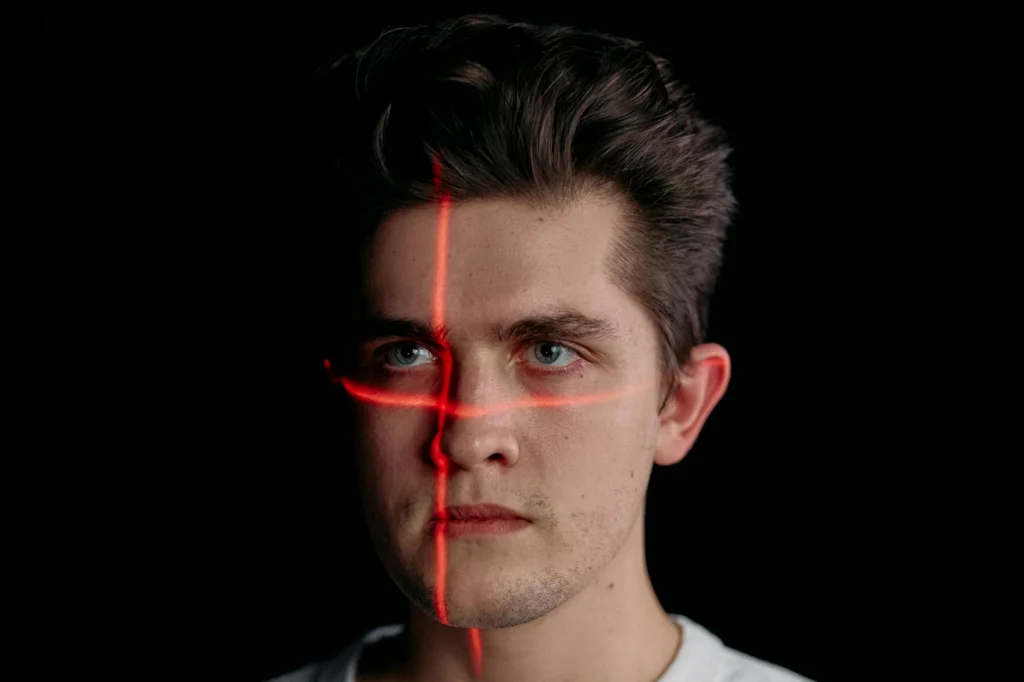

Blanquear el sesgo en un número objetivo

El problema más profundo de las herramientas de detección de IA no es que sean inexactas, aunque lo son. Es que convierten un juicio subjetivo y culturalmente cargado («esta escritura parece demasiado limpia para ser humana») en una puntuación numérica que parece objetiva. Un profesor que se negara a calificar el ensayo de un estudiante porque «suena demasiado pulido» enfrentaría objeciones razonables. Pero un profesor que señala una puntuación de probabilidad de IA del 94 % de GPTZero puede presentar la misma intuición como un análisis basado en datos.

Esto es blanqueo de sesgos. La herramienta hereda cada suposición incorporada en sus datos de entrenamiento y su umbral de detección, y luego presenta el resultado como una medición neutral. Las suposiciones incluyen: que la escritura humana es inherentemente desordenada, que la predictibilidad señala artificialidad, que la sofisticación lingüística en una segunda lengua es sospechosa. Ninguna de estas suposiciones se declara explícitamente. Ninguna es defendible. Pero están codificadas en el modelo y se entregan al usuario como un porcentaje.

El patrón es familiar. Algoritmos de calificación crediticia que penalizan códigos postales como sustituto de la raza. Herramientas de contratación que degradan currículos con nombres asociados a ciertas etnias. Modelos de predicción de reincidencia que señalan indicadores de pobreza como factores de riesgo. En cada caso, el mecanismo es el mismo: un sistema que transforma el sesgo estructural en un número y luego se esconde detrás de la aparente objetividad de ese número.

El punto final lógico: escribir peor para demostrar que eres humano

Si las herramientas de detección de IA se convierten en el estándar para evaluar la escritura, la estructura de incentivos se invierte. Los estudiantes aprenden a escribir menos claramente, a usar más coloquialismos, a introducir imperfecciones deliberadas y a evitar el tipo de argumentación estructurada que activa una alerta. Los profesionales aprenden a hacer su prosa más tosca. Los hablantes no nativos aprenden que su dominio cuidadoso y arduamente ganado del inglés constituye en sí mismo una prueba en su contra.

El punto final lógico de este sistema es absurdo y merece formularse con claridad: cuanto peor escribes, más humano eres. La claridad se vuelve sospechosa. La coherencia se convierte en evidencia de fraude. El mayor cumplido que una herramienta de detección puede hacerle a tu escritura es acusarte de no haberla escrito.

Esto no es hipotético. Estudiantes ya han sido acusados de usar IA por entregar trabajos bien escritos. Académicos han visto sus artículos señalados. El Center for Democracy and Technology publicó un informe en 2023 documentando los efectos desproporcionados sobre los estudiantes de inglés, advirtiendo que estas herramientas corren el riesgo de crear un sistema de dos niveles donde la competencia lingüística se convierte en un lastre.

El argumento más fuerte y por qué falla

El argumento más sólido a favor de estos productos de detección es que algo es mejor que nada. Las universidades enfrentan un problema genuino: los estudiantes ahora pueden generar ensayos aceptables con unas pocas pulsaciones, y la detección tradicional de plagio (que coteja contra una base de datos de textos existentes) no puede detectar producción original de IA. Las instituciones necesitan algún mecanismo para mantener la integridad académica, y los detectores imperfectos, según el argumento, al menos proporcionan un punto de partida para una investigación.

Este argumento falla por una razón específica. Una herramienta con una tasa de falsos positivos del 10 al 20 %, desplegada a gran escala entre miles de estudiantes, no proporciona un punto de partida para una investigación. Proporciona un punto de partida para una acusación. En la práctica, la puntuación se convierte en el veredicto. Los estudiantes señalados por estas herramientas cargan con la responsabilidad de demostrar que escribieron su propio trabajo, una inversión de la presunción de inocencia que sería inaceptable en cualquier otro contexto. Y los estudiantes con más probabilidades de ser señalados son aquellos cuyos patrones de escritura, ya sea por su trasfondo lingüístico o su disciplina estilística, casualmente se asemejan al perfil estadístico que la herramienta asocia con las máquinas.

El mejor enfoque es también el más difícil: diseñar evaluaciones que la IA no pueda replicar fácilmente (escritura en clase, defensa oral, documentación de proceso), invertir en una pedagogía que convierta la asistencia de IA en una herramienta en vez de un atajo, y aceptar que el panorama de la escritura ha cambiado de maneras que un producto comercial de detección no puede deshacer.

Lo que las herramientas de detección de IA realmente son

Las herramientas de detección de IA son productos de confianza. Venden certeza a instituciones ansiosas ante una tecnología que no comprenden completamente. La puntuación de probabilidad del 94 % no es una medición de la realidad. Es una medición del estado interno del modelo, que refleja las propiedades estadísticas de un texto frente a una distribución de entrenamiento que confunde claridad con artificialidad.

Las herramientas no saben quién escribió un texto. No pueden saberlo. Solo pueden reportar cuán sorprendido estaría un modelo de lenguaje por las elecciones léxicas del texto. Y la sorpresa, resulta, correlaciona pobremente con la autoría. Un humano que escribe con claridad no sorprende al modelo más que una máquina. Una máquina a la que se le indica escribir erráticamente no lo sorprende menos que un humano.

Hasta que estas herramientas se sometan a validación independiente, publiquen tasas de error honestas desglosadas por grupo demográfico y demuestren que su metodología puede sobrevivir a la revisión por pares, no deberían usarse en ninguna decisión que afecte la trayectoria académica, la carrera o la reputación de una persona. El estado actual de la detección de IA no es un problema tecnológico esperando un mejor algoritmo. Es un fracaso epistemológico: la creencia de que un sustituto estadístico del estilo de escritura puede sustituir el conocimiento de la autoría. No puede.